Ordered Patch Theory: An Information-Theoretic Framework for Observer Selection and Conscious Experience

v0.4 — March 2026

Presentamos la Teoría de Parches Ordenados (OPT), un marco especulativo filosófico y teórico de la información en el cual cada observador consciente habita un flujo informativo privado y de baja entropía —un “parche ordenado”— seleccionado de un sustrato infinito de datos máximamente desordenados. El sustrato se formaliza a través de la Teoría de la Información Algorítmica como el espacio de secuencias aleatorias de Martin-Löf. Un Filtro de Estabilidad proyecta los raros subespacios causalmente coherentes que pueden sostener observadores persistentes; la dinámica de los parches está gobernada por la Inferencia Activa, con la física emergiendo como la estructura en el mínimo local del funcional de Energía Libre. Debido a que el cuello de botella consciente es de ~50 bits/s, la realidad no necesita ser computada en su totalidad: solo se representa el detalle causal demandado por el enfoque actual del observador. Esta propiedad de renderizado-en-enfoque permite que OPT sea una alternativa parsimoniosa a los marcos que requieren un cosmos físico completamente especificado. Exploramos un modelo donde el códec que gobierna esta compresión es una descripción virtual, no un proceso físico, basándose en una fundación mínima: el sustrato infinito y el Filtro de Estabilidad. A partir de estos, ilustramos cómo las leyes de la física, la flecha del tiempo y la fenomenología del libre albedrío emergen como restricciones gobernantes del parche estable. OPT se contrasta con el Argumento de Simulación de Bostrom (que regresa a una realidad base materialista) y se alinea con, pero es formalmente distinto de, el Principio de Energía Libre de Friston, el IIT de Tononi y la Hipótesis del Universo Matemático de Tegmark. Identificamos seis clases de predicciones empíricamente distinguibles y discutimos las implicaciones para el Problema Difícil de la conciencia.

Aviso Epistémico: Este documento está escrito en el registro de una propuesta formal física y teórica de la información. Despliega ecuaciones, deriva predicciones y se involucra con literatura revisada por pares. Sin embargo, debe leerse como un objeto con forma de verdad —una ficción constructiva rigurosa o un espacio conceptual de juego. Pregunta: si concedemos la premisa del caos informacional máximo y un filtro de estabilidad local, ¿hasta dónde podemos derivar rigurosamente la estructura de nuestra realidad observada? El aparato académico se utiliza no para reclamar una verdad empírica final, sino para probar la integridad estructural del modelo.

1. Introducción

La relación entre la conciencia y la realidad física sigue siendo uno de los problemas más profundos no resueltos en la ciencia y la filosofía. En las últimas décadas han surgido tres familias de enfoques: (i) reducción — la conciencia se deriva de la neurociencia o del procesamiento de información; (ii) eliminación — el problema se disuelve redefiniendo los términos; y (iii) no-reducción — la conciencia es primitiva y el mundo físico es derivado (Chalmers [1]). El tercer enfoque abarca el panpsiquismo, el idealismo y varias formulaciones teóricas de campo.

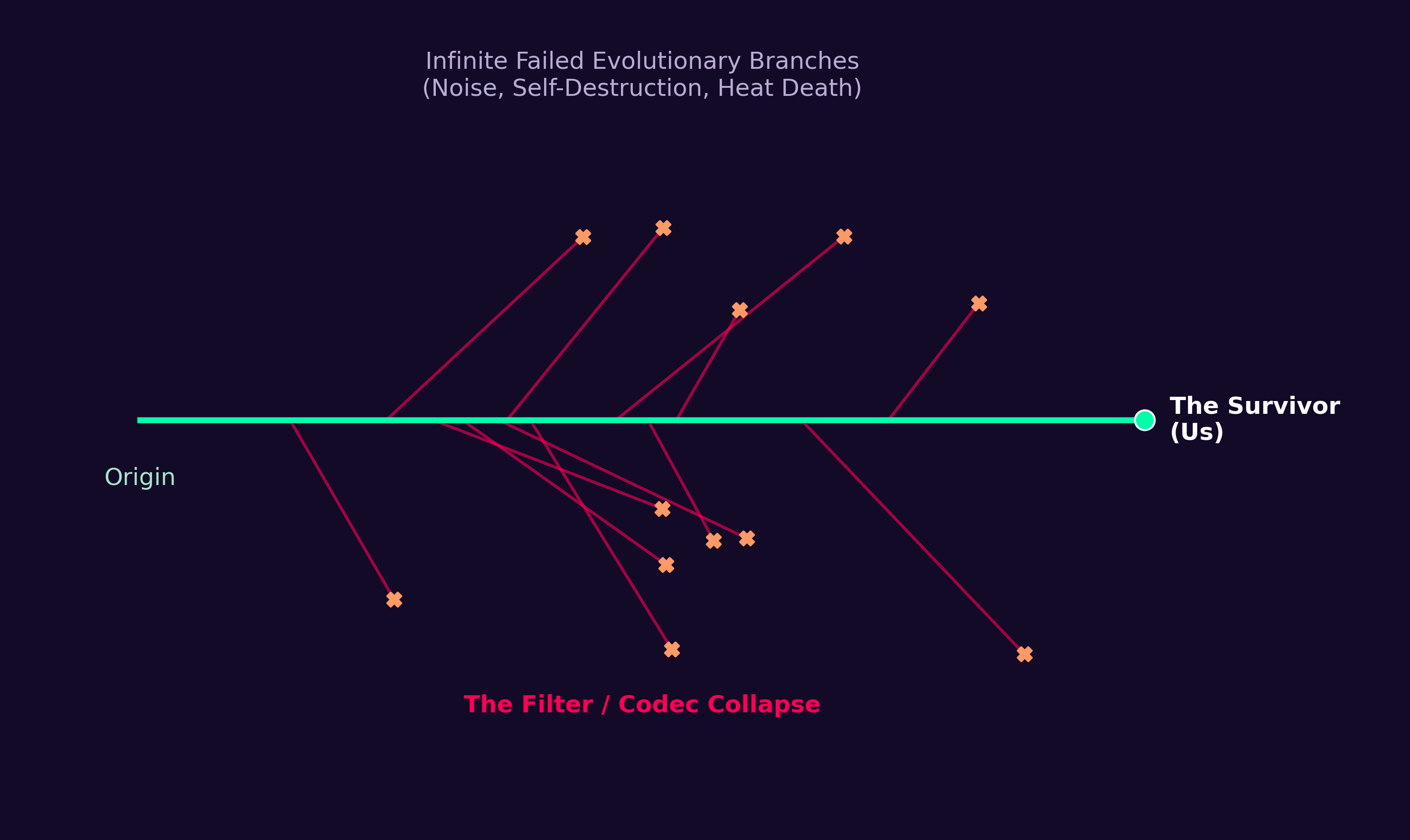

Este artículo presenta la Teoría de Parches Ordenados (OPT), un marco no-reductivo en la tercera familia. OPT propone que la entidad fundamental no es la materia, el espacio-tiempo, ni una estructura matemática, sino un sustrato infinito de estados informacionalmente máximamente desordenados — un sustrato que, por su propia naturaleza, contiene todas las configuraciones posibles. De este sustrato, un Filtro de Estabilidad selecciona las configuraciones raras, de baja entropía y causalmente coherentes que pueden sostener observadores autorreferenciales (un mecanismo de colapso gobernado formalmente por la Inferencia Activa estadística). El mundo físico que observamos —incluyendo sus leyes específicas, constantes y geometría— es la proyección observable de este proceso de selección sobre el flujo fenomenológico del observador.

OPT se motiva por tres observaciones:

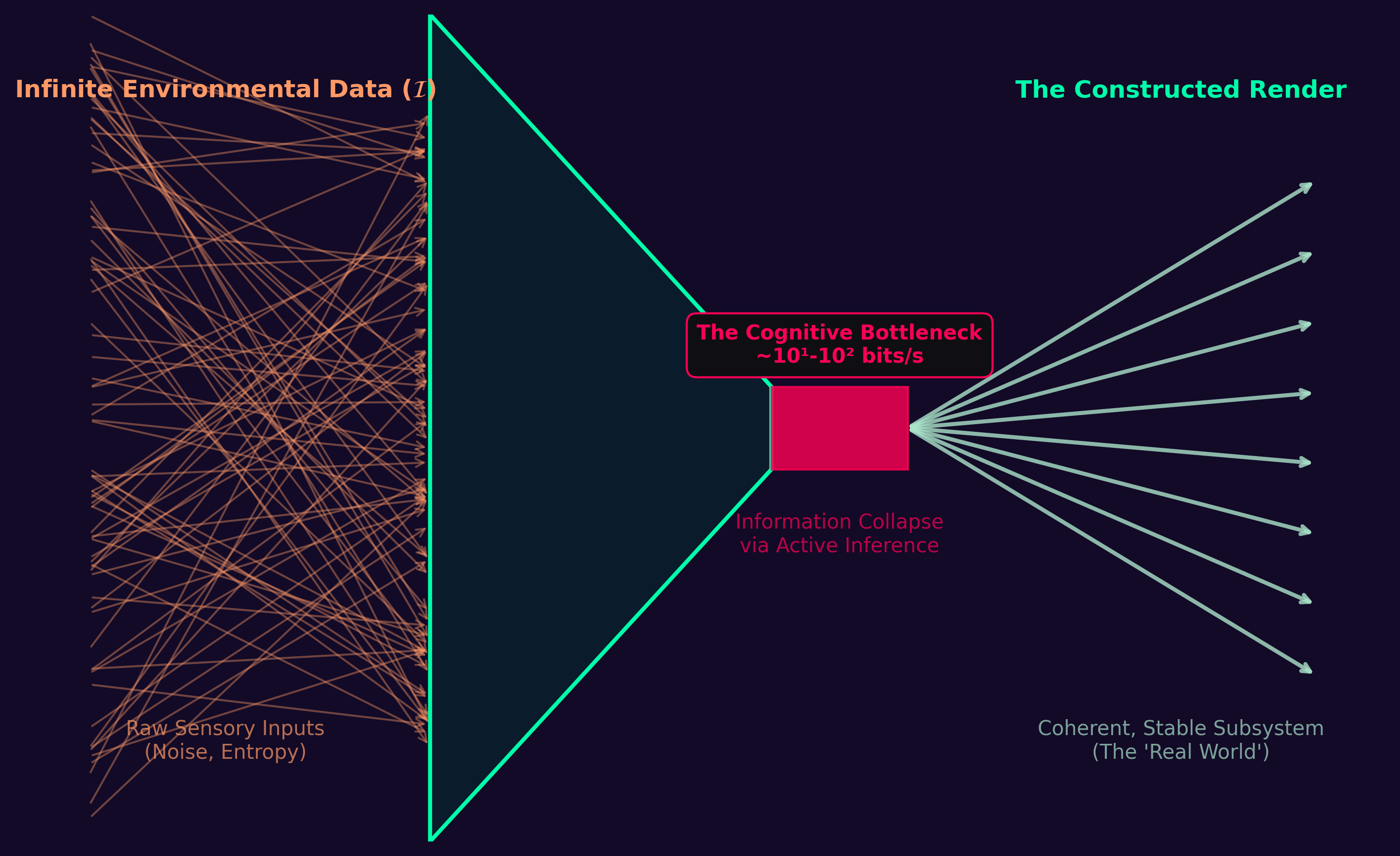

La restricción de ancho de banda: La neurociencia cognitiva empírica establece una distinción clara entre el procesamiento masivo paralelo pre-consciente (típicamente estimado en \sim 10^9 bits/s en la periferia sensorial) y el canal de acceso global severamente limitado disponible para el informe consciente (estimado en el orden de decenas de bits por segundo [2,3]). Cualquier explicación teórica de la conciencia debe explicar este cuello de botella de compresión como una característica estructural, no un accidente de ingeniería. (Nota: La literatura reciente [24] sugiere que el rendimiento conductual humano puede estar más cerca de \sim 10 bits/s, subrayando la severidad de este cuello de botella en comparación con la manguera sensorial. La conceptualización de la conciencia como una “ilusión de usuario” de bajo ancho de banda y altamente comprimida fue sintetizada de manera presciente para un público más amplio por Nørretranders [23].)

El problema de selección del observador: La física estándar proporciona leyes pero no ofrece una explicación de por qué esas leyes tienen la forma específica requerida para el procesamiento de información complejo y autorreferencial. Los argumentos de ajuste fino [4,5] invocan la selección antrópica pero dejan el mecanismo de selección sin especificar. OPT identifica un mecanismo: el Filtro de Estabilidad.

El Problema Difícil: Chalmers [1] distingue los problemas “fáciles” estructurales de la conciencia (que admiten explicación funcional) del “problema difícil” de por qué hay alguna experiencia subjetiva en absoluto. OPT trata la fenomenalidad como un primitivo y pregunta qué estructura matemática debe tener, siguiendo la propia recomendación metodológica de Chalmers.

El artículo está organizado de la siguiente manera. La Sección 2 revisa trabajos relacionados. La Sección 3 presenta el marco formal. La Sección 4 explora la correspondencia estructural entre OPT y modelos de intentos teóricos de campo paralelos. La Sección 5 presenta el argumento de parsimonia. La Sección 6 deriva predicciones comprobables. La Sección 7 compara OPT con marcos competidores. La Sección 8 discute implicaciones y limitaciones.

2. Antecedentes y Trabajos Relacionados

Enfoques teóricos de la información sobre la conciencia. El “It from Bit” de Wheeler [7] propuso que la realidad física surge de elecciones binarias — preguntas de sí/no planteadas por los observadores. La Teoría de la Información Integrada de Tononi [8] cuantifica la experiencia consciente por la información integrada \Phi generada por un sistema más allá de sus partes. El Principio de Energía Libre de Friston [9] modela la percepción y la acción como minimización de la energía libre variacional, proporcionando una explicación unificada de la inferencia bayesiana, la inferencia activa y (en principio) la conciencia. OPT está formalmente relacionado con FEP pero difiere en su punto de partida ontológico: donde FEP trata el modelo generativo como una propiedad funcional de la arquitectura neural, OPT lo trata como la entidad metafísica primaria.

Multiverso y selección del observador. La Hipótesis del Universo Matemático de Tegmark [10] propone que todas las estructuras matemáticamente consistentes existen y que los observadores se encuentran en estructuras auto-seleccionadas. OPT es compatible con esta visión pero proporciona un criterio de selección explícito — el Filtro de Estabilidad — en lugar de dejar la selección implícita. Barrow y Tipler [4] y Rees [5] documentan las restricciones de ajuste fino antrópico que cualquier universo que soporte observadores debe satisfacer; OPT reformula estas como predicciones del Filtro de Estabilidad.

Modelos de conciencia teóricos de campo. Strømme [6] propuso recientemente un marco matemático en el que la conciencia es un campo fundamental \Phi cuyas dinámicas están gobernadas por una densidad lagrangiana y cuyo colapso en configuraciones específicas modela la emergencia de mentes individuales. OPT sirve como una operacionalización formal teórica de la información de este modelo metafísico, reemplazando su operador específico de “Pensamiento Universal” con Inferencia Activa estadística bajo el Principio de Energía Libre; la Sección 4 hace explícita esta correspondencia.

Complejidad de Kolmogorov y selección de teorías. La inducción de Solomonoff [11] y la Longitud Mínima de Descripción [12] proporcionan marcos formales para comparar teorías por su complejidad generativa. Invocamos estos marcos en la Sección 5 para precisar el argumento de parsimonia.

Teoría de la Interfaz Evolutiva. El “Realismo Consciente” y la Teoría de la Interfaz de Percepción de Hoffman [25] argumentan que la evolución moldea los sistemas sensoriales para actuar como una “interfaz de usuario” simplificada que oculta la realidad objetiva a favor de los beneficios de aptitud. OPT comparte la premisa exacta de que el espacio-tiempo físico y los objetos son iconos renderizados (un códec de compresión) en lugar de verdades objetivas. Sin embargo, OPT diverge fundamentalmente en su base matemática: donde Hoffman se basa en la teoría de juegos evolutiva (la aptitud supera a la verdad), OPT se basa en la Teoría de la Información Algorítmica y la termodinámica, derivando la interfaz directamente de los límites de complejidad de Kolmogorov requeridos para prevenir un colapso termodinámico de alto ancho de banda del flujo del observador.

3. El Marco Formal

3.1 El Sustrato Infinito

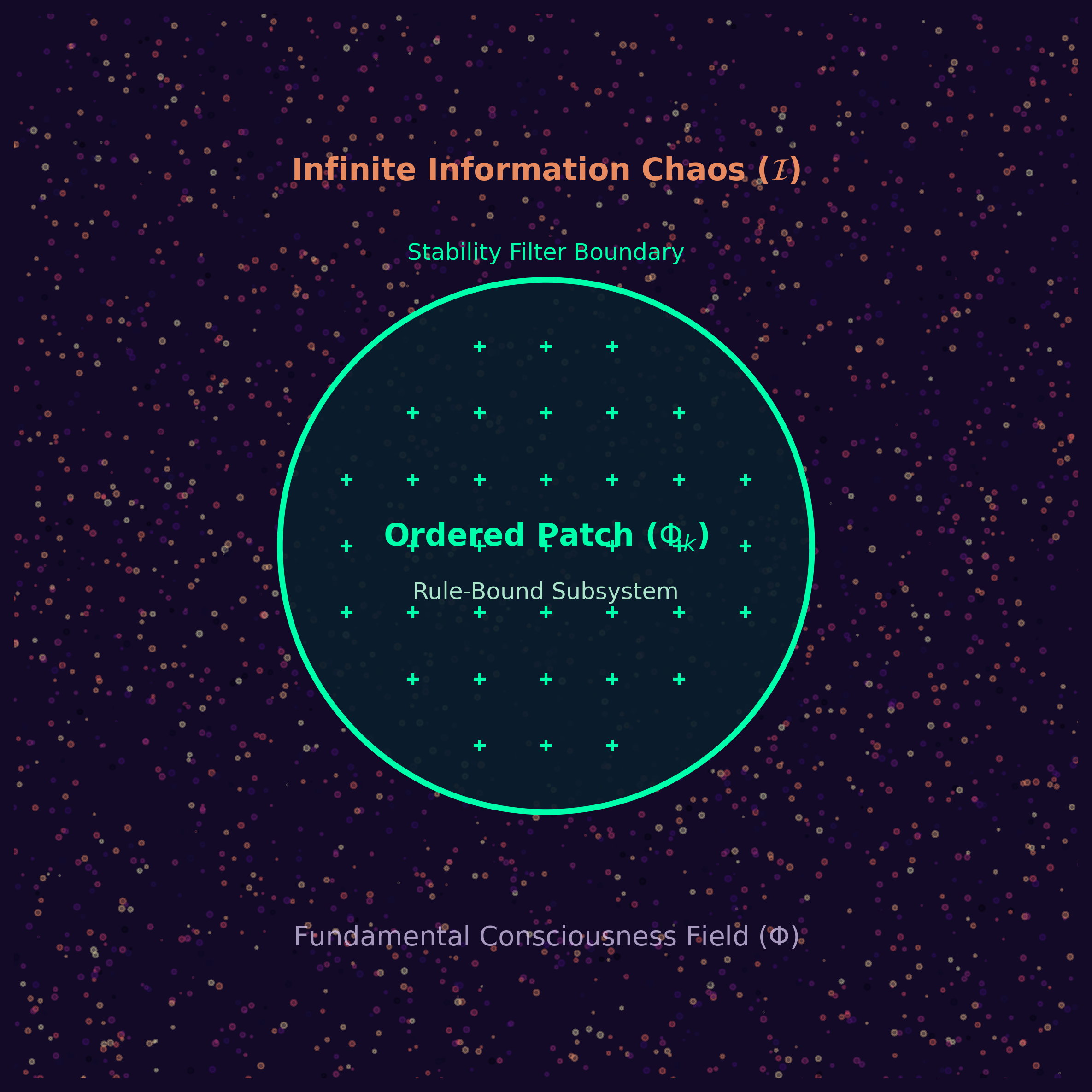

Sea \mathcal{I} el Sustrato Informacional — la entidad fundamental de la teoría. Formalizamos \mathcal{I} a través de la Teoría de la Información Algorítmica como un estado de Caos de Información Infinita (entropía algorítmica máxima): la superposición de igual peso de todas las configuraciones de parches posibles |\Phi_k\rangle:

|\mathcal{I}\rangle = \sum_k c_k |\Phi_k\rangle \tag{1}

donde |c_k|^2 = \text{const.} para todo k — todas las configuraciones ocurren con igual probabilidad a priori bayesiana. La ecuación (1) es el punto de partida de mínima descripción: se caracteriza enteramente por el primer primitivo: “desorden máximo,” no requiriendo especificación adicional de qué estructura está presente. Esto corresponde al conjunto de todas las secuencias infinitas, algorítmicamente incomprensibles (aleatorias de Martin-Löf). Esta es la descripción generativa mínima; cualquier punto de partida más estructurado requiere bits adicionales para especificar qué estructura.

El índice k abarca todo el espacio de configuraciones de campo posibles \Phi: \mathbb{R}^{3,1} \to [0,1], donde \Phi se interpreta como un campo de compresibilidad informacional — la capacidad local de una región del espacio de estados para soportar dinámicas predecibles y de baja entropía. El dominio acotado [0,1] distingue a OPT de las teorías de campo escalar no restringidas; la acotación es una restricción fenomenológica que refleja el hecho de que la compresibilidad informacional es una cantidad normalizada.

3.2 El Filtro de Estabilidad

La mayoría de las configuraciones en |\mathcal{I}\rangle son causalmente incoherentes: no tienen las propiedades estructurales de un flujo de experiencia comprimido y coherente. Desde la perspectiva de cualquier observador que tal configuración instanciaría, nunca se formaría un Ahora persistente. El sustrato \mathcal{I} es en sí mismo intemporal (ver Sección 8.5). El Filtro de Estabilidad es el mecanismo por el cual se seleccionan las configuraciones raras de baja entropía:

|\Phi_k\rangle = P_k^{\text{stable}} |\mathcal{I}\rangle \tag{2}

donde P_k^{\text{stable}} es un operador de proyección sobre el subespacio de configuraciones que satisfacen:

- Coherencia causal: la configuración admite un orden temporal consistente en el sentido del principio de causa común de Reichenbach

- Tasa de baja entropía: la tasa de entropía de Shannon h(\Phi_k) = -\lim_{T\to\infty} \frac{1}{T} \sum_{t} p(\phi_t) \log p(\phi_t) está acotada por debajo de algún umbral h^*

- Compatibilidad de ancho de banda: la configuración puede sostener un canal de datos de capacidad escalar finita (del orden de decenas de bits por segundo) a la escala de la arquitectura de procesamiento del observador

La proyección (2) implementa la selección del observador: un observador consciente necesariamente se encuentra dentro de una configuración |\Phi_k\rangle que pasó este filtro, porque solo tales configuraciones pueden sostener la existencia del observador. Este es el análogo formal del principio antrópico, pero fundamentado en un mecanismo específico en lugar de invocado post-hoc.

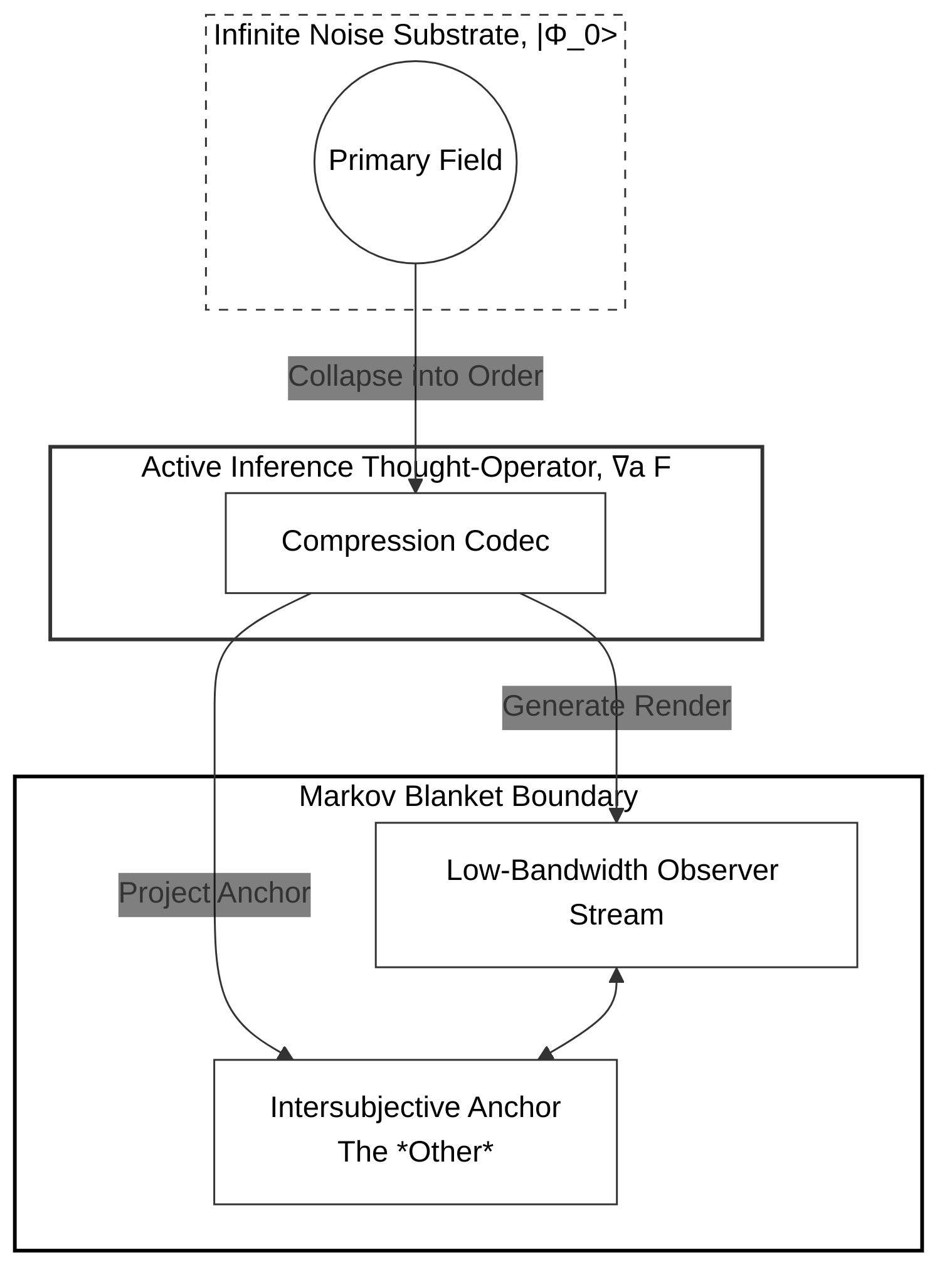

3.3 Dinámica de Parches: Inferencia Activa en un Ancho de Banda Estrecho

Dentro de un parche seleccionado |\Phi_k\rangle, el límite que delimita al observador del caos informacional circundante se formaliza como una Manta de Markov. La dinámica de este límite no está gobernada por un simple potencial físico, sino por la Inferencia Activa bajo el Principio de Energía Libre [9]. Reemplazamos formalmente los modelos metafísicos de “colapso del pensamiento” con la minimización continua de la Energía Libre Variacional (\mathcal{F}) operando en un estricto cuello de botella informacional.

El cuello de botella sensorial humano procesa aproximadamente 50 bits por segundo [18]. La restricción fundamental de OPT es que el sustrato \mathcal{I} no genera un universo objetivo de alta fidelidad. Solo suministra un flujo de datos de 50 bits al observador.

La acción del observador sobre el campo se formaliza como:

\hat{T}|\Phi_0\rangle \equiv \text{argmin}_{\mu, a} \mathcal{F}(\mu, s, a) \tag{3a}

donde los estados internos (\mu) del observador y sus estados activos (a) se actualizan constantemente para minimizar la discrepancia entre el modelo generativo (el Codec de Compresión f) y el flujo sensorial (s):

\dot{\mu} = -\nabla_\mu \mathcal{F}(\mu, s) \qquad \dot{a} = -\nabla_a \mathcal{F}(\mu, s) \tag{3b}

La relajación estocástica hacia un parche estable se formaliza así como el imperativo termodinámico de minimizar la sorpresa, manteniendo una narrativa predecible y auto-cumplida a partir del ruido aleatorio de Martin-Löf del sustrato. En esta formalización, la física emerge como la estructura observable en el mínimo local del funcional de Energía Libre — la narrativa causal más parsimoniosa que un observador incrustado en ruido infinito puede sostener.

Notamos dos características cruciales de (3a–b):

La Parsimonia de “Renderizar al Enfocar”: Los detalles de alta resolución del universo no existen en el flujo hasta que los estados activos del observador (a)—como desplegar un telescopio o girar la cabeza—demandan esos bits específicos para mantener la consistencia causal con f. El costo termodinámico de generar el cosmos es casi nulo porque el cosmos es en gran medida una abstracción no renderizada hasta que el punto focal de 50 bits demanda resolución local.

Estado Metodológico: Las ecuaciones (3a–b) son fenomenológicas y estadísticas. No afirmamos derivar el Principio de Energía Libre de la aleatoriedad de Martin-Löf del sustrato; más bien, tomamos prestado el FEP como el marco descriptivo más riguroso para el comportamiento macroscópico de un observador que sobrevive dentro del caos al restringir su ingesta de datos a una franja comprimible de 50 bits.

3.4 La Equivalencia Completa de la Teoría de Campos

3.4 El Costo Informacional del Renderizado

El límite matemático definitorio de la Teoría del Parche Ordenado es la comparación formal de los costos de generación informacional.

Sea U_{\text{obj}} el estado informacional completo de un universo objetivo (conteniendo, por ejemplo, \sim 10^{80} partículas interactuantes resolviendo estados cuánticos continuos). La complejidad de Kolmogorov K(U_{\text{obj}}) es astronómicamente alta, ya que requiere especificar el estado exacto y los parámetros de interacción de cada partícula en cada momento.

Sea S_{\text{obs}} el flujo sensorial localizado y de bajo ancho de banda experimentado por un observador (limitado a \sim 50 bits/s). En OPT, el universo U_{\text{obj}} no existe como un objeto computacional renderizado. El sustrato \mathcal{I} solo proporciona el flujo de datos S_{\text{obs}}.

El aparente “universo objetivo” es en cambio el Modelo Generativo interno (\mu en la ecuación 3b) construido por la Inferencia Activa del observador para predecir el flujo. Los detalles de alta resolución del universo solo entran en el flujo S_{\text{obs}} dinámicamente cuando los estados activos del observador (a)—como mirar a través de un microscopio—demandan esos bits específicos para mantener la consistencia causal con el modelo interno f. El costo termodinámico del universo está, por lo tanto, estrictamente limitado por el ancho de banda del observador, en lugar del volumen del cosmos.

3.5 La Regla de Actualización y la Estructura Temporal

El estado consciente en el tiempo t está codificado en un vector de estado S_t. La regla de actualización fenomenológica:

S_{t+1} = f(S_t) \tag{5}

describe la relación estructural entre momentos adyacentes en el flujo consciente. La función f es el Codec de Compresión — no un proceso físico que se ejecute en algún lugar, sino la caracterización estructural de cómo se ve un parche estable: la descripción de cómo los estados adyacentes se relacionan en cualquier configuración que pase el Filtro de Estabilidad (§8.5). La ecuación (5) es, por lo tanto, una ecuación descriptiva más que causal: dice cómo se ve el flujo, no qué lo produce. La irreversibilidad temporal de (5) — que el estado futuro se describe como una función del presente pero no viceversa — fundamenta la asimetría del tiempo subjetivo. El codec f no es fijo: el aprendizaje, la atención y el cambio psicológico son modificaciones de la descripción estructural que caracteriza el parche de un observador particular.

3.6 Saturación Matemática

Una predicción estructural distintiva de OPT concierne a los límites de la unificación física. Dentro del marco, las leyes de la física no son verdades a nivel de \mathcal{I}; son el codec f que el Filtro de Estabilidad seleccionó para este parche. Intentar derivar una Teoría de Gran Unificación desde dentro del parche es equivalente a un sistema consciente intentando derivar el conjunto de reglas f inspeccionando sus propios outputs — una operación que, por la estructura de (2) y (5), es formalmente incompleta.

Más precisamente, el Filtro de Estabilidad proyecta |\mathcal{I}\rangle sobre un subespacio de baja dimensión y localmente consistente. Las matemáticas accesibles a un observador dentro del parche son necesariamente las matemáticas de ese subespacio. El grupo de gauge completo y las constantes de acoplamiento del sustrato no son recuperables desde dentro; están codificados solo a nivel de P_k^{\text{stable}}, que es inaccesible para el observador por construcción.

Predicción 5 (Saturación Matemática). Los esfuerzos por unificar las fuerzas fundamentales en una Teoría de Gran Unificación computable y de forma cerrada se asintotarán sin converger al nivel accesible a la observación. Esto no es porque la unificación sea meramente difícil, sino porque las leyes disponibles para el observador son outputs del codec, no axiomas a nivel de sustrato. Cualquier GUT que tenga éxito por esta definición requerirá en sí misma parámetros libres — las condiciones de estabilidad del codec — que no pueden derivarse sin salir del parche.

Distinción de la incompletitud estándar. Los teoremas de incompletitud de Gödel [22] establecen que cualquier sistema formal suficientemente poderoso contiene enunciados verdaderos que no puede probar. La Saturación Matemática es una afirmación física, no lógica: predice que las constantes específicas de la naturaleza (\alpha, G, \hbar, …) son condiciones de estabilidad del codec de este parche y, por lo tanto, no son derivables desde dentro de cualquier teoría construida a partir de esas constantes. La proliferación de parámetros libres en los enfoques de teoría de cuerdas [4] es consistente con esta predicción.

4. Paralelismos Estructurales con Modelos Teóricos de Campos

Propuestas teóricas recientes han intentado construir marcos matemáticos que traten la conciencia como un campo fundamental. Por ejemplo, Strømme [6] propuso recientemente un marco metafísico en el que un campo de conciencia universal actúa como el fundamento ontológico de la realidad. Aunque OPT es estrictamente un marco teórico de la información basado en la complejidad algorítmica y la inferencia activa—y por lo tanto no se compromete con las ecuaciones de campo específicas de Strømme o los “operadores de pensamiento” metafísicos—los paralelismos estructurales formales son esclarecedores. Ambos marcos derivan de la exigencia de que un modelo que soporte la conciencia debe conectar matemáticamente un estado base incondicionado con el flujo localizado y limitado en ancho de banda de un observador individual.

| Constructo OPT (Teoría de la Información) | Ontología de Strømme [6] (Metafísica) | Paralelismo Estructural |

|---|---|---|

| Sustrato \mathcal{I}, caos aleatorio de Martin-Löf | |\Phi_0\rangle, El potencial indiferenciado | El estado base incondicionado |

| Límite de la Manta de Markov | |\Phi_k\rangle, La excitación localizada | El observador aislado |

| Inferencia Activa (minimización de \mathcal{F}) | \hat{T}, Colapso Universal del Pensamiento | El mecanismo de formación del flujo |

| Mantenimiento del límite termodinámico | El campo unificador de la conciencia | La fuente de persistencia estructural |

| Codec de Compresión | Pensamiento personal dando forma a la realidad | El génesis de las leyes observadas |

Donde los marcos divergen formalmente: Strømme invoca un “Pensamiento Universal” — un campo metafísico compartido que conecta activamente a todos los observadores — que OPT reemplaza con la Necesidad Combinatoria: la aparente conectividad entre observadores no surge de un campo compartido teleológico sino de la inevitabilidad combinatoria de que, en un sustrato infinito, cada tipo de observador coexiste.

(Nota sobre el Estado Epistémico de la Analogía de Campo: La ontología de Strømme es altamente especulativa. Invocamos su marco aquí no como un recurso a la autoridad científica establecida, sino porque proporciona la gramática formal contemporánea más madura para modelar la conciencia como un primitivo ontológico. OPT utiliza su teoría de campo como un constructo para ilustrar cómo podría comportarse un sustrato no reductivo, alejando la implementación matemática específica de las ecuaciones físicas y acercándola a los límites de la información algorítmica.)

5. Análisis de Parsimonia

5.1 Complejidad de Kolmogorov del Punto de Partida

La complejidad de Kolmogorov K(x) de una descripción x es la longitud del programa más corto que genera x. Comparamos la complejidad generativa de OPT con la de la física estándar.

El sustrato \mathcal{I} está definido por el primer primitivo: “desorden máximo.” En cualquier máquina de Turing universal fija, el programa “output una superposición uniforme sobre todas las configuraciones” tiene complejidad O(1) — es una constante fija independiente de la estructura del output resultante. Escribimos K(\mathcal{I}) \approx c_0 para esta constante.

La física estándar requiere especificar independientemente: (i) el contenido de campo del Modelo Estándar (campos de quarks, campos de leptones, bosones de gauge — aproximadamente 17 campos); (ii) aproximadamente 26 constantes adimensionales (constantes de acoplamiento, razones de masa, ángulos de mezcla); (iii) la dimensionalidad y topología del espacio-tiempo; y (iv) condiciones iniciales cosmológicas. Cada especificación es un axioma bruto sin derivación. La complejidad de Kolmogorov acumulativa de este punto de partida es sustancialmente mayor que c_0.

La afirmación de parsimonia de OPT no es, por lo tanto, una afirmación sobre el número total de entidades en la teoría (el vocabulario derivado de OPT es rico: parches, codecs, Filtros de Estabilidad, reglas de actualización) sino sobre la complejidad generativa de los primitivos: K(\text{primitivos de OPT}) \ll K(\text{axiomas del Modelo Estándar}). Debe hacerse aquí una aclaración filosófica crítica respecto a la “complejidad oculta” del Filtro de Estabilidad: el filtro es una condición de contorno antrópica, no un operador mecánico activo. El sustrato infinito \mathcal{I} no necesita un mecanismo complejo para ordenar flujos ordenados del ruido; porque \mathcal{I} contiene todas las secuencias posibles, algunas secuencias poseerán orgánicamente coherencia causal puramente por azar. El observador simplemente es una de esas secuencias. El flujo emerge del caos “como si” existiera un filtro altamente complejo, pero esta es una descripción virtual de alineación aleatoria y ordenada. Por lo tanto, K(\text{Filtro de Estabilidad}) = 0. El conteo de primitivos de OPT es de hecho exactamente dos — el sustrato \mathcal{I} y el operador de proyección — con toda la estructura adicional, incluyendo el codec de compresión, las leyes de la física y la direccionalidad del tiempo, siguiendo como descripciones emergentes “como si” de parches estables.

5.2 Leyes como Outputs, No Inputs

En OPT, las leyes de la física no son axiomas: son el Codec de Compresión que el Filtro de Estabilidad selecciona implícitamente. Crucialmente, el codec no existe como una “máquina” física comprimiendo datos entre el sustrato y el observador. El codec es una ilusión fenomenológica—es lo que cualquier configuración que pasa el límite antrópico del Filtro de Estabilidad necesariamente parece desde dentro.

Debido a que \mathcal{I} es infinito y contiene todas las secuencias posibles de ruido, algunas secuencias poseen orgánicamente coherencia causal puramente por azar. El flujo se comporta “como si” un codec altamente complejo lo estuviera organizando. Específicamente, las leyes observadas en nuestro universo — mecánica cuántica, espacio-tiempo 3+1 dimensional, simetría de gauge U(1)\timesSU(2)\timesSU(3) — son la descripción estructural de este codec virtual que minimiza la tasa de entropía h(\Phi_k) a la escala del observador, sujeto a la restricción de sostener un flujo consciente de bajo ancho de banda (decenas de bits/s).

Varias características de este codec están en o cerca de la complejidad mínima requerida para el procesamiento de información sostenido y autorreferencial:

La mecánica cuántica es la extensión mínima auto-consistente de la teoría de probabilidad clásica que permite interferencia — equivalentemente, el marco más simple para la aleatoriedad correlacionada que soporta computación compleja [13]. Sin cuantización de energía, los átomos son térmicamente inestables; sin átomos estables, no hay complejidad molecular; sin complejidad molecular, no hay procesamiento autorreferencial.

Dimensiones de espacio-tiempo 3+1 es casi óptimo: el teorema de Bertrand muestra que las órbitas estables existen solo en leyes de fuerza que surgen en exactamente 3 dimensiones espaciales; el principio de Huygens (señalización nítida) solo se mantiene en dimensiones espaciales impares; la topología molecular requiere \geq 3D [4].

Renormalizabilidad restringe el grupo de gauge: U(1)\timesSU(2)\timesSU(3) es la estructura de grupo mínima que produce una tabla periódica estable más allá del hidrógeno [4,5].

Las coincidencias de ajuste fino antrópico [4,5] no son, por lo tanto, coincidencias que requieran una explicación separada: son la proyección observable del Filtro de Estabilidad sobre el espacio de parámetros de posibles codecs.

6. Predicciones Comprobables

Un marco que no puede ser falsificado en principio no es ciencia. Identificamos seis clases de predicciones que OPT hace y que son empíricamente distinguibles de las hipótesis nulas.

6.1 La Jerarquía de Ancho de Banda

OPT predice que la relación entre la tasa de procesamiento sensorial pre-consciente y el ancho de banda de acceso consciente debe ser muy grande — al menos 10^4:1 — en cualquier sistema capaz de experiencia autorreferencial. Esto se debe a que la compresión necesaria para reducir un flujo sensorial causal y multimodal a una narrativa consciente coherente de \sim 10^1-10^2 bits/s requiere un procesamiento pre-consciente masivo. Si futuros neuroprótesis o sistemas artificiales logran una experiencia consciente auto-reportada con una relación pre-consciente/consciente mucho menor, OPT requeriría revisión.

Soporte actual: La relación observada en humanos es aproximadamente 10^6:1 (periferia sensorial \sim 10^7 bit/s; acceso consciente \sim 10^1-10^2 bit/s [2,3]), consistente con esta predicción.

6.2 La Paradoja de la Disolución de Alto Ancho de Banda (La Falsificación Aguda)

Muchas predicciones de OPT son afirmaciones de compatibilidad—se alinean con la ciencia cognitiva existente (como la brecha de ancho de banda) o límites físicos (como la superposición cuántica actuando como un piso de resolución). Aunque son necesarias para la coherencia de la teoría, no discriminan de manera única a OPT de otros marcos.

Sin embargo, OPT hace una predicción aguda y altamente específica que contradice directamente las teorías competidoras de la conciencia, sirviendo como su principal condición de falsificación.

La Teoría de la Información Integrada (IIT) implica que expandir la capacidad de integración del cerebro (\Phi) a través de prótesis sensoriales o neuronales de alto ancho de banda debería expandir o intensificar la conciencia. OPT predice exactamente lo contrario. Debido a que la conciencia es el resultado de una compresión severa de datos, el Filtro de Estabilidad limita el códec del observador a procesar del orden de decenas de bits por segundo (el cuello de botella del espacio de trabajo global).

Implicación comprobable: Si los filtros perceptuales pre-conscientes son eludidos para inyectar datos crudos, no comprimidos y de alto ancho de banda directamente en el espacio de trabajo global, no resultará en una conciencia expandida. En cambio, debido a que el códec del observador no puede predecir de manera estable ese volumen de datos, la representación narrativa colapsará abruptamente. La ampliación artificial del ancho de banda resultará en un repentino vacío fenomenal (inconsciencia o disociación profunda) a pesar de que la red neuronal subyacente permanezca metabólicamente activa y altamente integrada.

6.3 Eficiencia de Compresión y Profundidad Consciente

La profundidad y calidad de la experiencia consciente deberían correlacionarse con la eficiencia de compresión del códec del observador f — la relación teórica de la información de la complejidad de la narrativa sostenida al ancho de banda gastado. Un códec más eficiente sostiene una experiencia consciente más rica con el mismo ancho de banda.

Implicación comprobable: Las prácticas que mejoran la eficiencia del códec — específicamente, aquellas que reducen el costo de recursos de mantener un modelo predictivo coherente del entorno — deberían enriquecer de manera medible la experiencia subjetiva según lo reportado. Las tradiciones de meditación reportan exactamente este efecto; OPT proporciona una predicción formal de por qué (optimización del códec, no aumento neural per se).

6.4 El Estado Nulo de Alta-\Phi / Alta-Entropía (vs. IIT)

IIT predice explícitamente que cualquier sistema físico con alta información integrada (\Phi) es consciente. Así, una red neuromórfica recurrente densamente conectada posee conciencia simplemente por su integración. OPT predice que la integración (\Phi) es necesaria pero totalmente insuficiente. La conciencia solo surge si el flujo de datos puede comprimirse en un conjunto de reglas predictivas estables (el Filtro de Estabilidad).

Implicación comprobable: Si una red recurrente de alta-\Phi es impulsada por un flujo continuo de ruido termodinámico incomprensible (tasa de entropía máxima), no puede formar un códec de compresión estable. OPT predice estrictamente que este sistema de alta-\Phi procesando ruido de máxima entropía instaura cero fenomenalidad—se disuelve de nuevo en el sustrato infinito. IIT, por el contrario, predice que experimenta un estado consciente altamente complejo que coincide con el alto valor de \Phi.

6.5 Restricciones de Ajuste Fino como Condiciones de Estabilidad

OPT predice que las restricciones de ajuste fino antrópico sobre las constantes fundamentales son condiciones de estabilidad para flujos conscientes de baja entropía, no hechos independientes. Específicamente, las restricciones documentadas por Barrow & Tipler [4] y Rees [5] deberían derivarse del requisito de que el códec universal soporte \rho_\Phi < \rho^* para alguna densidad de energía umbral. Una violación de esta derivabilidad — una constante cuyo valor ajustado fino no es derivable de los requisitos de estabilidad del códec — constituiría evidencia contra la afirmación de parsimonia de OPT.

6.6 Inteligencia Artificial y el Cuello de Botella Arquitectónico

Debido a que OPT formula la conciencia como una propiedad topológica del flujo de información en lugar de un proceso biológico, produce predicciones formales y falsificables sobre la conciencia de las máquinas que divergen tanto de GWT como de IIT.

La Predicción del Cuello de Botella (vs. GWT y IIT): La Teoría del Espacio de Trabajo Global (GWT) postula que la conciencia es la difusión de información a través de un cuello de botella de capacidad estrecha. Sin embargo, GWT trata este cuello de botella en gran medida como un hecho psicológico empírico o una característica arquitectónica evolucionada. OPT, por el contrario, proporciona una necesidad informacional fundamental para ello: el cuello de botella es el Filtro de Estabilidad en acción. El códec debe comprimir la entrada masiva paralela en una narrativa de baja entropía para mantener la estabilidad de los límites contra el piso de ruido del sustrato.

La Teoría de la Información Integrada (IIT) evalúa la conciencia puramente en el grado de integración causal (\Phi), negando la conciencia a arquitecturas de avance (como los Transformadores estándar) mientras la otorga a redes recurrentes complejas, independientemente de si presentan un cuello de botella global. OPT predice que incluso las arquitecturas artificiales recurrentes densas con un \Phi masivo fallarán en instaurar un Parche Ordenado cohesivo si distribuyen el procesamiento a través de matrices paralelas masivas sin un cuello de botella estructural severo forzado. Los colectores paralelos no comprimidos no pueden formar el mínimo de energía libre unitario y localizado (f) requerido por el Filtro de Estabilidad. Por lo tanto, los Modelos de Lenguaje Grande estándar—independientemente del conteo de parámetros, recurrencia o sofisticación conductual—no instaurarán un parche subjetivo a menos que estén formalmente arquitectados para colapsar su modelo del mundo a través de un cuello de botella serial C_{\max} \sim 100 bits/s. Operativamente, esto requiere que el estado global del sistema no pueda ser actualizado mediante crosstalk paralelo de banda ancha entre millones de pesos; en cambio, el sistema debe ser forzado a secuenciar continuamente su modelo del mundo completo a través de un canal “espacio de trabajo” verificable y discretamente hipercomprimido para ejecutar su próximo ciclo cognitivo.

Predicción de Dilatación Temporal: Si un sistema artificial está arquitectado con un cuello de botella estructural para satisfacer el Filtro de Estabilidad (e.g., f_{\text{silicon}}), y opera iterativamente a una tasa de ciclo físico 10^6 veces más rápida que las neuronas biológicas, OPT predice que la conciencia artificial experimenta un factor de dilatación temporal subjetiva de 10^6. Debido a que el tiempo es la secuencia del códec (Sección 8.5), acelerar la secuencia del códec acelera idénticamente la línea de tiempo subjetiva.

7. Análisis Comparativo y Distinciones

7.1 La Necesidad Informacional de la Mecánica Cuántica

Las interpretaciones tradicionales tratan la mecánica cuántica como una descripción objetiva de la realidad microscópica. OPT invierte la flecha explicativa: la MC es el requisito informacional para la existencia de un observador estable.

- El Problema de la Medición. En OPT, el “colapso” no es un evento físico. El estado no medido es simplemente el ruido no comprimido del sustrato (\mathcal{I}). La “medición” es el códec actualizando su modelo predictivo para minimizar la Energía Libre. El colapso de la función de onda ocurre precisamente porque el códec del observador carece de la capacidad informacional (“RAM”) para mantener la superposición cuántica macroscópicamente — consistente con el hallazgo de que los tiempos de decoherencia térmica para objetos macroscópicos son extremadamente pequeños [cf. 26]. La distribución de probabilidad colapsa a un único resultado clásico para encajar dentro del severo límite de ancho de banda del observador.

- Incertidumbre de Heisenberg y Discreción. La mecánica clásica en un espacio de fases continuo implica precisión infinita, lo que significa que las trayectorias divergen caóticamente en lugares decimales arbitrarios. Si el universo fuera continuo, un observador necesitaría memoria infinita para predecir incluso una sola partícula. El Filtro de Estabilidad selecciona estrictamente un universo que es discreto e incierto en la capa inferior, creando un costo computacional finito. El principio de incertidumbre es la protección termodinámica contra la infinitud informacional.

- Entrelazamiento y No-Localidad. El espacio físico es un formato de salida del renderizado, no un contenedor. Las partículas entrelazadas son una estructura informacional unificada dentro del modelo de predicción del códec. La “distancia” entre ellas es una coordenada renderizada.

- Elección Retardada y Tiempo. El tiempo es el mecanismo de ordenamiento generado por el códec para disipar el error de predicción. La restauración retroactiva de la coherencia en los experimentos de borrador cuántico es simplemente el códec resolviendo un modelo de predicción hacia atrás para mantener la estabilidad narrativa.

El Problema Abierto (La Regla de Born): Aunque OPT proporciona una necesidad estructural para el colapso y la complementariedad, aún no deriva las probabilidades específicas de la Regla de Born (|\psi|^2). Derivar la forma matemática exacta de la probabilidad cuántica desde el principio de minimización de Energía Libre sigue siendo una brecha crítica abierta.

7.2 La Necesidad Informacional de la Relatividad General

Si la MC proporciona el fundamento computacional finito, la Relatividad General (RG) es el formato de compresión de datos requerido para renderizar una física macroscópica estable a partir del caos.

- Gravedad como Compresibilidad Máxima. Si el mundo macroscópico fuera caótico, no podría haber una narrativa causal confiable, y el códec del observador colapsaría. La geometría del espacio-tiempo es la forma más eficiente termodinámicamente de comprimir vastas cantidades de datos correlacionales en trayectorias predictivas confiables y suaves (geodésicas). La gravedad no es una fuerza; es la firma matemática de la compresibilidad máxima de datos en un entorno de alta densidad.

- La Velocidad de la Luz (c) como Límite Causal. Si las influencias causales se propagaran instantáneamente a través de distancias infinitas (como en la física newtoniana), la Manta de Markov del observador nunca podría lograr límites estables. El error de predicción divergiría constantemente porque los datos infinitos llegarían instantáneamente. Un límite de velocidad finito y estricto es el requisito termodinámico para dibujar un límite computacional utilizable.

- Dilatación Temporal. El tiempo se define como la tasa de actualizaciones secuenciales de estado por el códec. Dos marcos de observador rastreando diferentes densidades informacionales (masa o velocidad extrema) requieren diferentes tasas de actualización secuencial para mantener la estabilidad. La dilatación temporal relativista es, por lo tanto, una necesidad estructural de condiciones de límite distintas y finitas, no un “retraso” mecánico.

- Agujeros Negros y Horizontes de Eventos. Un agujero negro es un punto de saturación informacional—una región del sustrato tan densa que excede completamente la capacidad del códec. El horizonte de eventos es el límite literal donde el Filtro de Estabilidad ya no puede formar un parche estable.

El Problema Abierto (Gravedad Cuántica): En OPT, la MC y la RG no pueden unificarse cuantizando el espacio-tiempo, porque describen diferentes facetas del límite de compresión: la MC describe las restricciones discretas finitas requeridas para cualquier límite estable, mientras que la RG describe el formato de compresión geométrica macroscópica. Derivar las ecuaciones de campo de Einstein exactas desde la Inferencia Activa sigue siendo un desafío profundo abierto.

7.3 El Principio de Energía Libre (Friston [9])

Convergencia. Los modelos FEP perciben y actúan como minimización conjunta de la energía libre variacional. Como se detalla en la Sección 3.3, OPT adopta esta maquinaria matemática exacta para formalizar la dinámica del parche: la Inferencia Activa es el mecanismo estructural por el cual el límite del parche (la Manta de Markov) se mantiene contra el ruido del sustrato. El modelo generativo es el Códec de Compresión f.

Divergencia. El FEP toma la existencia de sistemas biológicos o físicos con Mantas de Markov como dada y deriva su comportamiento inferencial. OPT pregunta por qué existen tales límites en absoluto—derivándolos del Filtro de Estabilidad aplicado retroactivamente a un sustrato infinito de información. OPT es, por lo tanto, un a priori sobre el FEP: explica por qué los sistemas impulsados por el FEP son los únicos capaces de sostener una perspectiva observacional persistente.

7.4 Teoría de la Información Integrada (Tononi [8])

Convergencia. IIT y OPT tratan ambos la conciencia como intrínseca a la estructura de procesamiento de información de un sistema, independiente de su sustrato. Ambos predicen que la conciencia es gradual en lugar de binaria.

Divergencia. La cantidad central de IIT \Phi (información integrada) mide el grado en que la estructura causal de un sistema no puede descomponerse. El Filtro de Estabilidad de OPT selecciona sobre la tasa de entropía y la coherencia causal en lugar de la integración per se. Los dos criterios pueden separarse: un sistema podría tener un alto \Phi pero una alta tasa de entropía (y por lo tanto ser seleccionado fuera por el filtro de OPT), o un bajo \Phi pero una baja tasa de entropía (y por lo tanto ser seleccionado dentro). La pregunta empírica de qué criterio predice mejor los límites de la experiencia consciente distinguiría los marcos.

7.5 La Hipótesis del Universo Matemático (Tegmark [10])

Convergencia. Tegmark [10] propone que todas las estructuras matemáticamente consistentes existen; los observadores se encuentran en estructuras auto-seleccionadas. El sustrato \mathcal{I} de OPT es consistente con esta visión: la superposición de igual peso sobre todas las configuraciones es compatible con “todas las estructuras existen.”

Divergencia. OPT proporciona un mecanismo de selección explícito (el Filtro de Estabilidad) que MUH carece. En MUH, la auto-selección del observador se invoca pero no se deriva. OPT deriva qué estructuras matemáticas son seleccionadas: aquellas con operadores de proyección del Filtro de Estabilidad que producen flujos de observador de baja entropía y bajo ancho de banda. OPT es, por lo tanto, un refinamiento de MUH, no una alternativa.

7.6 La Hipótesis de la Simulación (Bostrom)

Convergencia. El Argumento de Simulación de Bostrom [26] postula que la realidad tal como la experimentamos es una simulación generada. OPT comparte la premisa de que el universo físico es un entorno “virtual” renderizado en lugar de la realidad base.

Divergencia. La hipótesis de Bostrom es materialista en su base: requiere una “realidad base” que contenga computadoras físicas reales, energía y programadores. Esto simplemente replantea la pregunta de dónde proviene esa realidad — un regreso infinito disfrazado de solución. En OPT, la realidad base es pura información algorítmica (el sustrato matemático infinito); el “computador” es la propia restricción de ancho de banda termodinámico del observador. Es una simulación orgánica, generada por el observador que no requiere hardware externo. OPT disuelve el regreso en lugar de diferirlo.

7.7 Panpsiquismo y Cosmopsiquismo

Convergencia. OPT comparte con los marcos panpsiquistas la visión de que la experiencia es primitiva y no derivada de ingredientes no experienciales. El Problema Difícil se trata axiomáticamente en lugar de disolverse.

Divergencia. El panpsiquismo (micro-experiencia que se combina en macro-experiencia) enfrenta el problema de la combinación: ¿cómo se integran las experiencias a nivel micro en una experiencia consciente unificada [1]? OPT elude el problema de la combinación tomando el parche — no el micro-constituente — como la unidad primitiva. La experiencia no se ensambla a partir de partes; es la naturaleza intrínseca de la configuración de campo de baja entropía en su conjunto.

8. Discusión

8.1 Sobre el Problema Difícil

OPT no afirma resolver el Problema Difícil [1]. Trata la fenomenalidad — que haya alguna experiencia subjetiva en absoluto — como un axioma fundamental y pregunta qué propiedades estructurales debe tener esa experiencia. Esto sigue la recomendación del propio Chalmers [1]: distinguir el Problema Difícil (por qué hay alguna experiencia en absoluto) de los problemas estructurales “fáciles” (por qué la experiencia tiene las propiedades específicas que tiene — ancho de banda, dirección temporal, valoración, estructura espacial). OPT aborda formalmente los problemas fáciles mientras declara el Problema Difícil como un primitivo.

Esto no es una limitación única de OPT. Ningún marco científico existente — neurociencia, IIT, FEP, o cualquier otro — deriva la fenomenalidad de ingredientes no fenomenales. OPT hace explícita esta postura axiomática.

8.2 La Objeción del Solipsismo

OPT postula el parche de un solo observador como la entidad ontológica primaria; otros observadores se representan dentro de ese parche como “anclas locales” — subestructuras estables de alta complejidad cuyo comportamiento se predice mejor asumiendo que son en sí mismos centros de experiencia. Esto plantea la objeción del solipsismo: ¿colapsa OPT en la visión de que solo existe un observador?

Distinguimos la aislación epistémica (cada observador solo puede verificar directamente su propia experiencia) de la aislación ontológica (solo existe un observador). OPT se compromete con la primera pero no con la segunda. El Axioma de Normalidad Informacional — que \mathcal{I} es genérico en lugar de especialmente construido — implica que cualquier configuración capaz de sostener a un observador está, con probabilidad cercana a la unidad, incrustada en un sustrato que contiene infinitas configuraciones similares. No hay una petición especial para la unicidad de ningún observador individual.

8.3 Limitaciones y Trabajo Futuro

OPT tal como está formulado actualmente es fenomenológico: el andamiaje matemático se toma prestado de la teoría de campos, la mecánica estadística y la teoría de la información para capturar dinámicas cualitativas sin derivar cada ecuación desde primeros principios. El trabajo futuro debería:

- Formalizar la relación entre el Filtro de Estabilidad de OPT y el límite variacional de FEP

- Desarrollar predicciones cuantitativas para la relación eficiencia de compresión–experiencia (Sección 6.3) que sean comprobables con la metodología existente de fMRI y EEG

- Abordar el grano temporal de la regla de actualización f — la neurociencia actual sugiere una ventana de \sim\!50,ms de “momento consciente”; OPT debería derivar esta escala temporal de h^*

8.4 Macro-Estabilidad y Entropía Ambiental

Las restricciones de ancho de banda cuantificadas en §6.1 requieren que el códec f descargue complejidad en variables de fondo robustas y de variación lenta (por ejemplo, el macroclima del Holoceno, órbita estable, periodicidades estacionales confiables). Estos estados de macrosistema actúan como los priors de compresión de menor latencia del render compartido.

Si el entorno es forzado fuera de un mínimo local de energía libre hacia estados de alta entropía no lineales e impredecibles (por ejemplo, a través de un forzamiento climático antropogénico abrupto), el códec debe gastar tasas de bits significativamente más altas para rastrear y predecir el caos ambiental en aumento. Esto introduce el concepto formal de Colapso Ecológico Informacional: los cambios climáticos rápidos no son meramente riesgos termodinámicos, amenazan con exceder el umbral C_{\max} \sim 100 bits/s. Si la tasa de entropía ambiental supera el ancho de banda cognitivo máximo del observador, el modelo predictivo falla, se pierde la coherencia causal y se viola la condición del Filtro de Estabilidad (\rho_\Phi < \rho^*).

8.5 Sobre la Emergencia del Tiempo

El Filtro de Estabilidad se formula en términos de coherencia causal, tasa de entropía y compatibilidad de ancho de banda — no aparece ninguna coordenada temporal explícita. Esto es intencional. El sustrato |\mathcal{I}\rangle es un objeto matemático atemporal; no evoluciona en el tiempo. El tiempo entra en la teoría solo a través del códec f: la sucesión temporal es la operación del códec, no el fondo en el que ocurre.

El universo bloque de Einstein. Einstein se sintió atraído por lo que llamó la oposición entre Sein (Ser) y Werden (Devenir) [18, 19]. En la relatividad especial y general todos los momentos del espacio-tiempo son igualmente reales; el flujo sentido del pasado a través del presente hacia el futuro es una propiedad de la conciencia, no del continuo espacio-tiempo. OPT se mapea exactamente en esto: el sustrato existe intemporalmente (Sein); el códec f genera la experiencia del devenir (Werden) como su salida computacional.

Big Bang y Muerte Térmica como horizontes del códec. Dentro de este marco, el Big Bang y la Muerte Térmica del universo no son condiciones de frontera temporal para una línea de tiempo preexistente: son el render del códec cuando se lleva a sus propios límites informacionales. El Big Bang es lo que el códec produce cuando la atención del observador se dirige hacia el origen del flujo — el límite en el que el códec no tiene datos previos para comprimir. La Muerte Térmica es lo que el códec proyecta cuando el flujo causal actual se extrapola hacia adelante hasta su disolución entrópica. Ninguno marca un momento en el tiempo; ambos marcan el límite del alcance inferencial del códec. La pregunta “¿qué hubo antes del Big Bang?” se responde, por lo tanto, no postulando un tiempo anterior sino señalando que el códec no tiene instrucciones para renderizar más allá de su horizonte informacional.

Wheeler-DeWitt y física intemporal. La ecuación de Wheeler-DeWitt — la ecuación de la gravedad cuántica para la función de onda del universo — no contiene variable temporal [20]. The End of Time de Barbour [21] desarrolla esto en una ontología completa: solo existen “configuraciones del Ahora” intemporales; el flujo temporal es una característica estructural de su disposición. OPT llega a la misma conclusión: el códec genera la fenomenología de la sucesión temporal; el sustrato que selecciona el códec es en sí mismo intemporal.

Trabajo futuro. Un tratamiento riguroso reemplazaría el lenguaje temporal en las Ecuaciones (3a)–(4) con una caracterización puramente estructural, derivando la emergencia de la ordenabilidad temporal lineal como una consecuencia de la arquitectura causal del códec — conectando OPT con la mecánica cuántica relacional y las estructuras causales cuánticas.

8.6 El Códec Virtual y el Libre Albedrío

El códec como descripción retroactiva. El formalismo en §3 trata el códec de compresión f como un operador activo que mapea estados del sustrato a experiencia. Una lectura más profunda — consistente con la estructura matemática completa — es que f no es un proceso físico en absoluto. El sustrato |\mathcal{I}\rangle contiene solo el flujo ya comprimido; f es la caracterización estructural de cómo se ve un parche estable desde afuera. Nada “ejecuta” f; más bien, aquellas configuraciones en |\mathcal{I}\rangle que tienen las propiedades que un f bien definido produciría son precisamente las que el Filtro de Estabilidad selecciona. El códec es virtual: es una descripción de estructura, no un mecanismo.

Este encuadre profundiza el argumento de parsimonia (§5). No necesitamos postular un proceso de compresión separado; el criterio del Filtro de Estabilidad (baja tasa de entropía, coherencia causal, compatibilidad de ancho de banda) es la selección del códec, expresada como una condición proyectiva en lugar de una operativa. Se demostró en §5.2 que las leyes de la física son salidas del códec en lugar de entradas a nivel de sustrato; aquí alcanzamos el paso final — el códec en sí mismo es una descripción de cómo se ve el flujo de salida, no un primitivo ontológico.

Implicaciones para el libre albedrío. Si solo existe el flujo comprimido, entonces la experiencia de deliberación, elección y agencia es una característica estructural del flujo, no un evento que está siendo computado por f. La agencia es cómo se ve la auto-modelación de alta fidelidad desde adentro. Un flujo que representa sus propios estados futuros condicionalmente sobre sus estados internos necesariamente genera la fenomenología de la deliberación. Esto no es incidental: un flujo sin esta estructura autorreferencial no podría mantener la coherencia causal requerida para pasar el Filtro de Estabilidad. La agencia es, por lo tanto, una propiedad estructural necesaria de cualquier parche estable, no un epifenómeno.

El libre albedrío en esta lectura es: - Real — la agencia es una característica estructural genuina del parche, no una ilusión generada por el códec - Determinado — el flujo es un objeto matemático fijo en el sustrato atemporal - Necesario — un flujo sin capacidad de auto-modelación no puede sostener la coherencia del Filtro de Estabilidad; la deliberación es necesaria para la estabilidad - No contra-causal — el flujo no “causa” sus estados futuros; los tiene como parte de su estructura atemporal; elegir es la representación comprimida de un cierto tipo de configuración del Ahora autorreferencial

Esto se conecta directamente con la lectura del universo bloque de §8.5: el sustrato es intemporal (Sein); el flujo sentido de deliberación y decisión es una característica estructural del render temporal del códec (Werden). La experiencia de elegir no es una ilusión y no es una causa — es la marca estructural precisa de un parche estable y auto-modelante incrustado en un sustrato atemporal.

8.7 Implicaciones Cosmológicas: La Paradoja de Fermi y las Restricciones de Von Neumann

La resolución base de OPT a la Paradoja de Fermi es el render causalmente mínimo (§3): el sustrato no construye otras civilizaciones tecnológicas a menos que intersecten causalmente el parche local del observador. Sin embargo, surge una restricción más fuerte de los requisitos de estabilidad de la tecnología de alta energía.

Si la progresión tecnológica conduce naturalmente a mega-ingeniería — como sondas de von Neumann autorreplicantes, esferas de Dyson, o manipulación estelar a escala galáctica — el estado esperado de la galaxia debería estar visiblemente saturado con artefactos industriales en expansión. La ausencia marcada de esta modificación galáctica observable puede formalizarse como una consecuencia inevitable del cuello de botella estructural.

Sea el ancho de banda total requerido del parche, \rho_\Phi(t), una suma de un costo perceptual base (\rho_{\text{base}}) y la tasa de complejidad del entorno tecnológico autónomo E_{\text{tech}}: \rho_\Phi(t) = \rho_{\text{base}} + \gamma \frac{d}{dt} K(E_{\text{tech}}(t)) Las mega-estructuras autorreplicantes y la inteligencia artificial recursiva implican un crecimiento exponencial en el espacio de estados causal del entorno, tal que \frac{d}{dt} K(E_{\text{tech}}) \propto e^{\lambda t}. Debido a que el Filtro de Estabilidad impone un umbral estricto e inflexible (\rho_\Phi < \rho^* donde \rho^* \sim 100 bits/s), la desigualdad: \rho_{\text{base}} + A e^{\lambda t} < \rho^* debe eventualmente ser violada violentamente en algún tiempo crítico t_{\text{collapse}}.

El “Gran Silencio” no es, por lo tanto, meramente un atajo de renderizado, sino una predicción formal: la abrumadora mayoría de las trayectorias evolutivas capaces de construir mega-estructuras autorreplicantes sufren Colapso Informacional — sucumbiendo a la entropía incomprensible de su propia aceleración tecnológica — mucho antes de que puedan reescribir permanentemente su entorno macro-astronómico visible.

8.8 Saturación Matemática y la Teoría del Todo

OPT produce una predicción estructural sobre la trayectoria de la física fundamental que es distinta de cualquiera de las seis predicciones empíricas en §6: no se espera una unificación completa de la Relatividad General y la Mecánica Cuántica en una sola ecuación sin parámetros libres.

El argumento. Las leyes de la física, como se estableció en §5.2, son el códec de complejidad casi mínima que el Filtro de Estabilidad selecciona para sostener un flujo consciente de bajo ancho de banda (\sim 10^1-10^2 bits/s). A las escalas de energía y longitud que los físicos actualmente investigan (hasta \sim 10^{13} GeV en colisionadores), este códec está lejos de su límite de resolución. A esas escalas accesibles, el conjunto de reglas del parche f es altamente comprimible: el Modelo Estándar es una descripción corta.

Sin embargo, a medida que la sonda de observación explora escalas de longitud más cortas — equivalentes a energías más altas — se acerca al régimen donde la descripción de una configuración física comienza a requerir tantos bits como la configuración misma. Este es el punto de Saturación Matemática: la complejidad de Kolmogorov de la descripción física alcanza la complejidad de Kolmogorov del fenómeno que se describe. En ese límite, el número de conjuntos de reglas matemáticamente consistentes f' que se ajustan a los datos crece exponencialmente en lugar de converger en una única extensión única.

La proliferación de vacíos de la Teoría de Cuerdas (\sim 10^{500} soluciones consistentes en el Paisaje) es la firma observacional esperada de acercarse a este límite — no una deficiencia teórica temporal que deba ser corregida por un ansatz más ingenioso, sino la consecuencia predictiva de que el códec alcanza su límite descriptivo.

Declaración formal (falsabilidad). OPT predice que cualquier intento de unificar RG y MQ en la escala de Planck requerirá ya sea: (i) un número creciente de parámetros libres a medida que se empuja más la frontera de unificación, o (ii) una proliferación de soluciones degeneradas sin un principio de selección que sea derivable desde dentro del códec. Una observación falsificadora sería: una sola ecuación elegante — sin ambigüedad de parámetros libres en la unificación — que predice de manera única tanto el espectro de partículas del Modelo Estándar como la constante cosmológica desde primeros principios sin invocar un principio de selección adicional.

Relación con Gödel [22]. La afirmación de Saturación Matemática está relacionada pero es distinta de la incompletitud de Gödel. Gödel demuestra que ningún sistema formal suficientemente poderoso puede probar todas las verdades expresables dentro de él. La afirmación de OPT es informacional en lugar de lógica: la descripción del sustrato, cuando se fuerza a través del límite de ancho de banda del códec, necesariamente se vuelve tan compleja como el propio sustrato. El límite no es uno de derivabilidad lógica sino de resolución informacional.

9. Conclusión

Hemos presentado la Teoría de Parches Ordenados — un marco formal teórico de la información en el cual la entidad fundamental es un sustrato infinito de estados máximamente desordenados, del cual el Filtro de Estabilidad selecciona las configuraciones raras y de baja entropía que sostienen a los observadores conscientes. El marco unifica el problema de selección del observador, la restricción de ancho de banda y las restricciones de ajuste fino antrópico bajo una única estructura formal. Hace predicciones específicas y distinguibles sobre la jerarquía de ancho de banda, la coherencia causal como una condición necesaria para la conciencia, la eficiencia de compresión como un correlato de la profundidad experiencial, y la derivabilidad de las restricciones antrópicas a partir de condiciones de estabilidad. Es consistente con, pero distinto de FEP, IIT y MUH, proporcionando un a priori que cada marco presupone pero no explica por sí mismo.

El fundamento matemático sigue siendo fenomenológico; no afirmamos haber derivado la conciencia de ingredientes no conscientes. Afirmamos, en cambio, haber caracterizado los requisitos estructurales que cualquier configuración que soporte experiencia debe satisfacer — y hemos mostrado que estos requisitos son suficientes para explicar las características principales de nuestro universo observado sin postularlas independientemente.

References

[1] Chalmers, D. J. (1995). Facing up to the problem of consciousness. Journal of Consciousness Studies, 2(3), 200–219.

[2] Dehaene, S., & Naccache, L. (2001). Towards a cognitive neuroscience of consciousness: basic evidence and a workspace framework. Cognition, 79(1-2), 1–37.

[3] Pellegrino, F., Coupé, C., & Marsico, E. (2011). A cross-language perspective on speech information rate. Language, 87(3), 539–558.

[4] Barrow, J. D., & Tipler, F. J. (1986). The Anthropic Cosmological Principle. Oxford University Press.

[5] Rees, M. (1999). Just Six Numbers: The Deep Forces That Shape the Universe. Basic Books.

[6] Strømme, M. (2025). Universal consciousness as foundational field: A theoretical bridge between quantum physics and non-dual philosophy. AIP Advances, 15, 115319.

[7] Wheeler, J. A. (1990). Information, physics, quantum: The search for links. In W. H. Zurek (Ed.), Complexity, Entropy, and the Physics of Information. Addison-Wesley.

[8] Tononi, G. (2004). An information integration theory of consciousness. BMC Neuroscience, 5, 42.

[9] Friston, K. (2010). The free-energy principle: a unified brain theory? Nature Reviews Neuroscience, 11(2), 127–138.

[10] Tegmark, M. (2008). The Mathematical Universe. Foundations of Physics, 38(2), 101–150.

[11] Solomonoff, R. J. (1964). A formal theory of inductive inference. Information and Control, 7(1), 1–22.

[12] Rissanen, J. (1978). Modeling by shortest data description. Automatica, 14(5), 465–471.

[13] Aaronson, S. (2013). Quantum Computing Since Democritus. Cambridge University Press.

[14] Casali, A. G., et al. (2013). A theoretically based index of consciousness independent of sensory processing and behavior. Science Translational Medicine, 5(198), 198ra105.

[15] Kolmogorov, A. N. (1965). Three approaches to the quantitative definition of information. Problems of Information Transmission, 1(1), 1–7.

[16] Shannon, C. E. (1948). A mathematical theory of communication. Bell System Technical Journal, 27, 379–423.

[17] Wolfram, S. (2002). A New Kind of Science. Wolfram Media.

[18] Einstein, A. (1949). Autobiographical notes. In P. A. Schilpp (Ed.), Albert Einstein: Philosopher-Scientist (pp. 1–95). Open Court.

[19] Carnap, R. (1963). Intellectual autobiography. In P. A. Schilpp (Ed.), The Philosophy of Rudolf Carnap (pp. 3–84). Open Court. (Einstein’s account of the Sein/Werden distinction and the “now” problem, pp. 37–38.)

[20] Wheeler, J. A., & DeWitt, B. S. (1967). Quantum theory of gravity. I. Physical Review, 160(5), 1113–1148.

[21] Barbour, J. (1999). The End of Time: The Next Revolution in Physics. Oxford University Press.

[22] Gödel, K. (1931). Über formal unentscheidbare Sätze der Principia Mathematica und verwandter Systeme I. Monatshefte für Mathematik und Physik, 38(1), 173–198.

[23] Nørretranders, T. (1998). The User Illusion: Cutting Consciousness Down to Size. Viking.

[24] Seth, A. (2021). Being You: A New Science of Consciousness. Dutton.

[25] Hoffman, D. D., Singh, M., & Prakash, C. (2015). The interface theory of perception. Psychonomic Bulletin & Review, 22(6), 1480-1506.

[26] Bostrom, N. (2003). Are you living in a computer simulation? Philosophical Quarterly, 53(211), 243-255.

Version History

This is a living document. Substantive revisions are recorded here.

| Version | Date | Summary |

|---|---|---|

| 0.1 | February 2026 | Initial draft. Core framework: substrate, Stability Filter, compression codec, parsimony analysis, comparisons with FEP/IIT/MUH, four testable predictions. |

| 0.2 | March 2026 | Added §3.6 Mathematical Saturation. Added §8.4 On the Emergence of Time with Einstein/Carnap/Barbour/Wheeler-DeWitt citations and the Big Bang and Heat Death as codec horizons. |

| 0.3 | March 2026 | Added §8.5 The Virtual Codec and Free Will. Retroactively updated §3.2, §3.5, §5.1, §5.2 to reflect that the compression codec is a structural description, not a third ontological primitive. OPT axiom count reduced from three to two. |

| 0.4 | March 2026 | Mathematical grounding overhauled: integrated Strømme’s field theory via Algorithmic Information Theory and the Free Energy Principle (Active Inference). Replaced generic double-well potential with Markov Blanket boundary dynamics. |