Ordered Patch Theory: An Information-Theoretic Framework for Observer Selection and Conscious Experience

v0.4 — March 2026

Presentiamo la Teoria delle Patch Ordinate (OPT), un quadro speculativo filosofico e teorico dell’informazione in cui ogni osservatore cosciente abita un flusso informativo privato e a bassa entropia — una “patch ordinata” — selezionata da un substrato infinito di dati massimamente disordinati. Il substrato è formalizzato tramite la Teoria dell’Informazione Algoritmica come lo spazio delle sequenze casuali di Martin-Löf. Un Filtro di Stabilità proietta gli spazi sottostanti rari e coerenti causalmente che possono sostenere osservatori persistenti; la dinamica delle patch è governata dall’Inferenza Attiva, con la fisica che emerge come la struttura al minimo locale del funzionale di Energia Libera. Poiché il collo di bottiglia cosciente è di ~50 bit/s, la realtà non deve essere calcolata completamente: solo il dettaglio causale richiesto dall’attuale focus dell’osservatore viene reso. Questa proprietà di render-on-focus permette all’OPT di essere un’alternativa parsimoniosa ai quadri che richiedono un cosmo fisico completamente specificato. Esploriamo un modello in cui il codec che governa questa compressione è una descrizione virtuale, non un processo fisico, basato su una fondazione minima: il substrato infinito e il Filtro di Stabilità. Da questi, illustriamo come le leggi della fisica, la freccia del tempo e la fenomenologia del libero arbitrio emergano come vincoli governanti della patch stabile. L’OPT è contrapposta all’Argomento della Simulazione di Bostrom (che regredisce a una realtà materiale di base) e allineata con, ma formalmente distinta da, il Principio di Energia Libera di Friston, l’IIT di Tononi e l’Ipotesi dell’Universo Matematico di Tegmark. Identifichiamo sei classi di previsioni empiricamente distinguibili e discutiamo le implicazioni per il Problema Duro della coscienza.

Avviso Epistemico: Questo documento è scritto nel registro di una proposta formale fisica e teorica dell’informazione. Utilizza equazioni, deriva previsioni e si confronta con la letteratura sottoposta a revisione paritaria. Tuttavia, dovrebbe essere letto come un oggetto a forma di verità — una rigorosa finzione costruttiva o sandbox concettuale. Si chiede: se concediamo il presupposto del caos informativo massimo e di un filtro di stabilità locale, fino a che punto possiamo derivare rigorosamente la struttura della nostra realtà osservata? L’apparato accademico è utilizzato non per affermare una verità empirica finale, ma per testare l’integrità strutturale del modello.

1. Introduzione

La relazione tra coscienza e realtà fisica rimane uno dei problemi più profondi e irrisolti nella scienza e nella filosofia. Negli ultimi decenni sono emerse tre famiglie di approcci: (i) riduzione — la coscienza è derivabile dalle neuroscienze o dall’elaborazione delle informazioni; (ii) eliminazione — il problema viene dissolto ridefinendo i termini; e (iii) non-riduzione — la coscienza è primitiva e il mondo fisico è derivato (Chalmers [1]). Il terzo approccio comprende il panpsichismo, l’idealismo e varie formulazioni teoriche di campo.

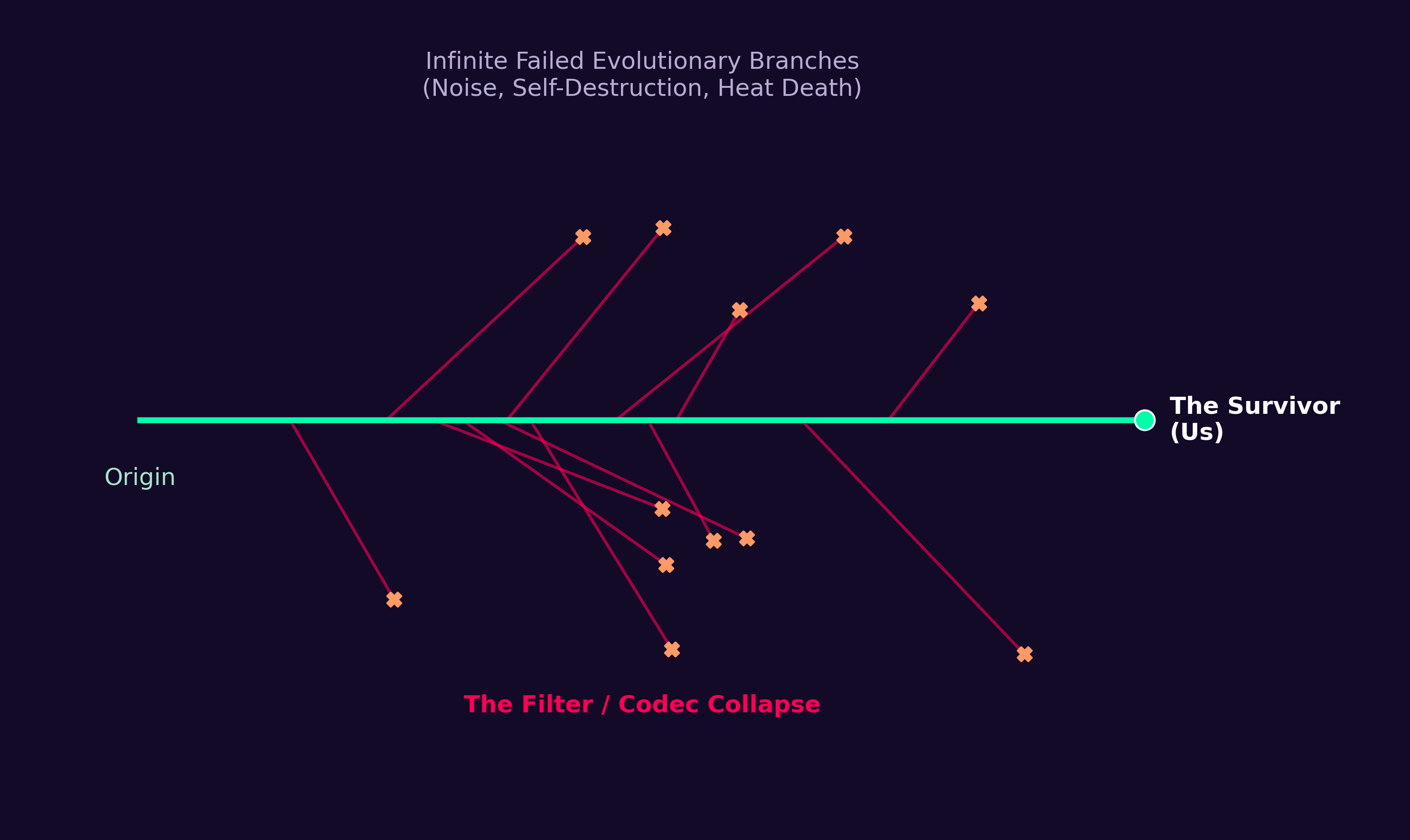

Questo documento presenta la Teoria delle Patch Ordinate (OPT), un quadro non riduttivo appartenente alla terza famiglia. OPT propone che l’entità fondamentale non sia la materia, lo spazio-tempo o una struttura matematica, ma un substrato infinito di stati massimamente disordinati dal punto di vista informativo — un substrato che, per sua stessa natura, contiene ogni possibile configurazione. Da questo substrato, un Filtro di Stabilità seleziona le configurazioni rare, a bassa entropia e causalmente coerenti che possono sostenere osservatori auto-referenziali (un meccanismo di collasso governato formalmente dall’Inferenza Attiva statistica). Il mondo fisico che osserviamo — comprese le sue leggi specifiche, costanti e geometria — è la proiezione osservabile di questo processo di selezione sul flusso fenomenologico dell’osservatore.

OPT è motivata da tre osservazioni:

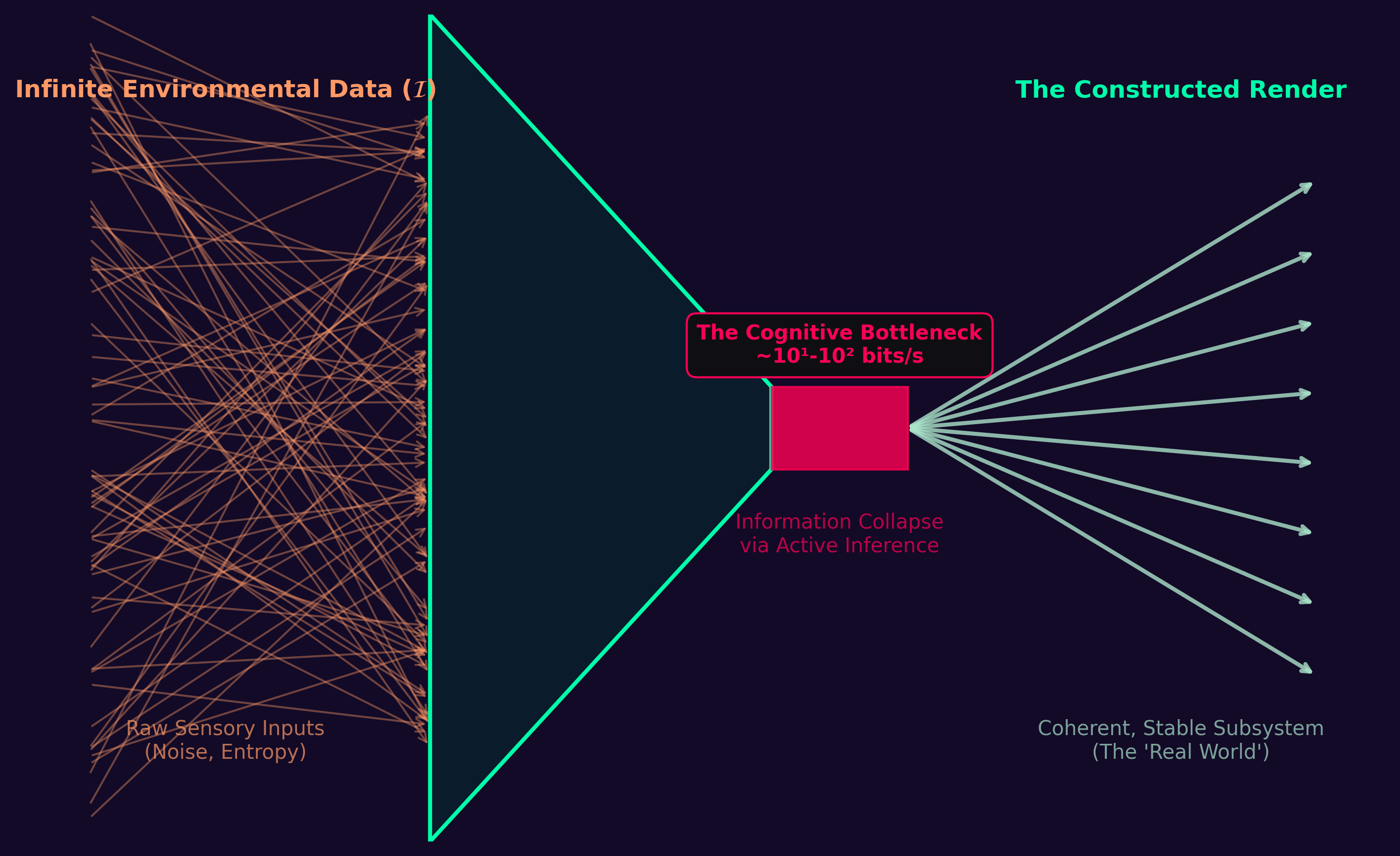

Il vincolo di larghezza di banda: La neuroscienza cognitiva empirica stabilisce una netta distinzione tra l’elaborazione pre-cosciente massivamente parallela (tipicamente stimata a \sim 10^9 bit/s alla periferia sensoriale) e il canale di accesso globale severamente limitato disponibile per il resoconto cosciente (stimato nell’ordine di decine di bit al secondo [2,3]). Qualsiasi spiegazione teorica della coscienza deve spiegare questo collo di bottiglia di compressione come una caratteristica strutturale, non un incidente ingegneristico. (Nota: La letteratura recente [24] suggerisce che la capacità comportamentale umana possa essere più vicina a \sim 10 bit/s, sottolineando la gravità di questo collo di bottiglia rispetto al flusso sensoriale. La concettualizzazione della coscienza come un’illusione “utente” a bassa larghezza di banda e altamente compressa è stata sinteticamente presentata a un pubblico più ampio da Nørretranders [23].)

Il problema della selezione dell’osservatore: La fisica standard fornisce leggi ma non offre una spiegazione del perché quelle leggi abbiano la forma specifica richiesta per l’elaborazione complessa e auto-referenziale delle informazioni. Gli argomenti di fine-tuning [4,5] invocano la selezione antropica ma lasciano il meccanismo di selezione non specificato. OPT identifica un meccanismo: il Filtro di Stabilità.

Il Problema Difficile: Chalmers [1] distingue i problemi “facili” strutturali della coscienza (che ammettono una spiegazione funzionale) dal “problema difficile” del perché ci sia un’esperienza soggettiva. OPT tratta la fenomenalità come un primitivo e chiede quale struttura matematica debba avere, seguendo la raccomandazione metodologica di Chalmers.

Il documento è organizzato come segue. La Sezione 2 rivede i lavori correlati. La Sezione 3 presenta il quadro formale. La Sezione 4 esplora la corrispondenza strutturale tra OPT e i modelli tentativi teorici di campo paralleli. La Sezione 5 presenta l’argomento della parsimonia. La Sezione 6 deriva previsioni verificabili. La Sezione 7 confronta OPT con quadri concorrenti. La Sezione 8 discute implicazioni e limitazioni.

2. Contesto e Lavori Correlati

Approcci informazionali alla coscienza. L’“It from Bit” di Wheeler [7] propone che la realtà fisica derivi da scelte binarie — domande sì/no poste dagli osservatori. La Teoria dell’Informazione Integrata di Tononi [8] quantifica l’esperienza cosciente attraverso l’informazione integrata \Phi generata da un sistema al di sopra e al di là delle sue parti. Il Principio di Energia Libera di Friston [9] modella la percezione e l’azione come minimizzazione dell’energia libera variazionale, fornendo un resoconto unificato dell’inferenza bayesiana, dell’inferenza attiva e (in linea di principio) della coscienza. OPT è formalmente correlato a FEP ma differisce nel suo punto di partenza ontologico: dove FEP tratta il modello generativo come una proprietà funzionale dell’architettura neurale, OPT lo tratta come l’entità metafisica primaria.

Multiverso e selezione dell’osservatore. L’Ipotesi dell’Universo Matematico di Tegmark [10] propone che tutte le strutture matematicamente consistenti esistano e che gli osservatori si trovino in strutture auto-selezionate. OPT è compatibile con questa visione ma fornisce un criterio di selezione esplicito — il Filtro di Stabilità — piuttosto che lasciare la selezione implicita. Barrow e Tipler [4] e Rees [5] documentano i vincoli di fine-tuning antropico che qualsiasi universo che supporta osservatori deve soddisfare; OPT riformula questi come predizioni del Filtro di Stabilità.

Modelli di coscienza teorico-campo. Strømme [6] ha recentemente proposto un quadro matematico in cui la coscienza è un campo fondamentale \Phi le cui dinamiche sono governate da una densità lagrangiana e il cui collasso su configurazioni specifiche modella l’emergere delle menti individuali. OPT serve come un’operazionalizzazione formale informazionale-teorica di questo modello metafisico, sostituendo il suo specifico operatore di “Pensiero Universale” con l’Inferenza Attiva statistica sotto il Principio di Energia Libera; la Sezione 4 rende esplicita questa corrispondenza.

Complessità di Kolmogorov e selezione delle teorie. L’induzione di Solomonoff [11] e la Lunghezza Minima di Descrizione [12] forniscono quadri formali per confrontare teorie in base alla loro complessità generativa. Invochiamo questi quadri nella Sezione 5 per rendere preciso il concetto di parsimonia.

Teoria dell’Interfaccia Evolutiva. Il “Realismo Cosciente” di Hoffman e la Teoria dell’Interfaccia della Percezione [25] sostengono che l’evoluzione modella i sistemi sensoriali per agire come un’interfaccia “utente” semplificata che nasconde la realtà oggettiva a favore dei benefici di fitness. OPT condivide l’esatto presupposto che lo spaziotempo fisico e gli oggetti siano icone rese (un codec di compressione) piuttosto che verità oggettive. Tuttavia, OPT diverge fondamentalmente nel suo fondamento matematico: dove Hoffman si basa sulla teoria dei giochi evolutiva (il fitness batte la verità), OPT si basa sulla Teoria dell’Informazione Algoritmica e sulla termodinamica, derivando l’interfaccia direttamente dai limiti di complessità di Kolmogorov richiesti per prevenire un collasso termodinamico ad alta larghezza di banda del flusso dell’osservatore.

3. Il Quadro Formale

3.1 Il Substrato Infinito

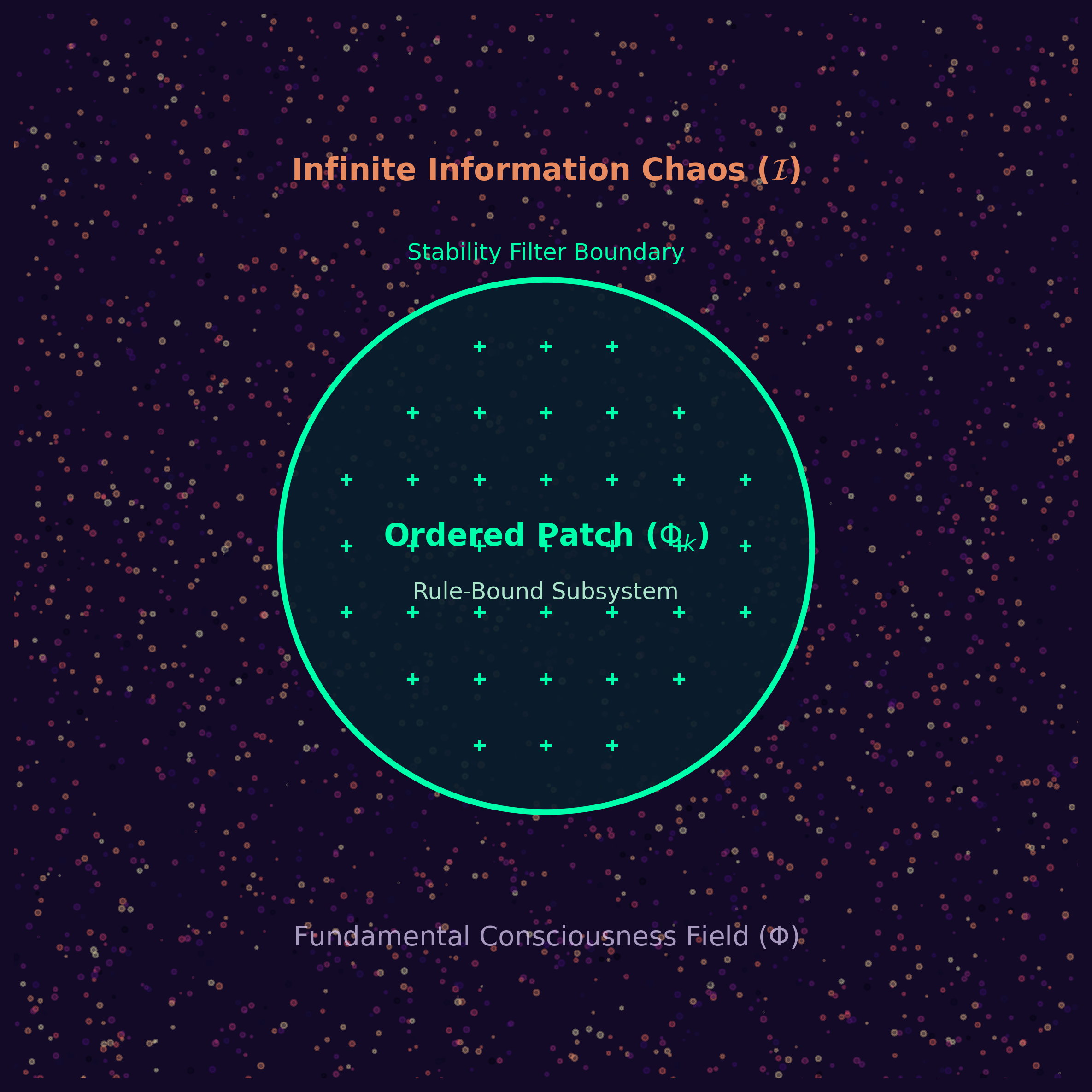

Sia \mathcal{I} a denotare il Substrato Informativo — l’entità fondamentale della teoria. Formalizziamo \mathcal{I} tramite la Teoria dell’Informazione Algoritmica come uno stato di Caos Informativo Infinito (massima entropia algoritmica): la sovrapposizione a peso uguale di tutte le possibili configurazioni di patch |\Phi_k\rangle:

|\mathcal{I}\rangle = \sum_k c_k |\Phi_k\rangle \tag{1}

dove |c_k|^2 = \text{const.} per tutti i k — tutte le configurazioni si verificano con uguale probabilità a priori bayesiana. L’equazione (1) è il punto di partenza a minima descrizione: è caratterizzata interamente dal primo primitivo: “disordine massimo,” che non richiede specificazioni aggiuntive su quale struttura sia presente. Questo corrisponde all’insieme di tutte le sequenze infinite, algoritmicamente incomprimibili (casuali secondo Martin-Löf). Questa è la descrizione generativa minima; qualsiasi punto di partenza più strutturato richiede bit aggiuntivi per specificare quale struttura.

L’indice k varia sull’intero spazio delle possibili configurazioni di campo \Phi: \mathbb{R}^{3,1} \to [0,1], dove \Phi è interpretato come un campo di comprimibilità informativa — la capacità locale di una regione dello spazio degli stati di supportare dinamiche a bassa entropia, prevedibili. Il dominio limitato [0,1] distingue OPT dalle teorie dei campi scalari non limitate; la limitatezza è un vincolo fenomenologico che riflette il fatto che la comprimibilità informativa è una quantità normalizzata.

3.2 Il Filtro di Stabilità

La maggior parte delle configurazioni in |\mathcal{I}\rangle sono causalmente incoerenti: non possiedono le proprietà strutturali di un flusso di esperienza compresso e coerente. Dal punto di vista di qualsiasi osservatore che una tale configurazione potrebbe istanziare, non si formerebbe mai un Adesso persistente. Il substrato \mathcal{I} è esso stesso senza tempo (vedi Sezione 8.5). Il Filtro di Stabilità è il meccanismo attraverso il quale vengono selezionate le rare configurazioni a bassa entropia:

|\Phi_k\rangle = P_k^{\text{stable}} |\mathcal{I}\rangle \tag{2}

dove P_k^{\text{stable}} è un operatore di proiezione sul sottospazio delle configurazioni che soddisfano:

- Coerenza causale: la configurazione ammette un ordinamento temporale coerente nel senso del principio di causa comune di Reichenbach

- Basso tasso di entropia: il tasso di entropia di Shannon h(\Phi_k) = -\lim_{T\to\infty} \frac{1}{T} \sum_{t} p(\phi_t) \log p(\phi_t) è limitato al di sotto di una certa soglia h^*

- Compatibilità di larghezza di banda: la configurazione può sostenere un canale dati di capacità scalare finita (dell’ordine di decine di bit al secondo) alla scala dell’architettura di elaborazione dell’osservatore

La proiezione (2) implementa la selezione dell’osservatore: un osservatore cosciente si trova necessariamente all’interno di una configurazione |\Phi_k\rangle che ha superato questo filtro, perché solo tali configurazioni possono sostenere l’esistenza dell’osservatore. Questo è l’analogo formale del principio antropico, ma fondato su un meccanismo specifico piuttosto che invocato post-hoc.

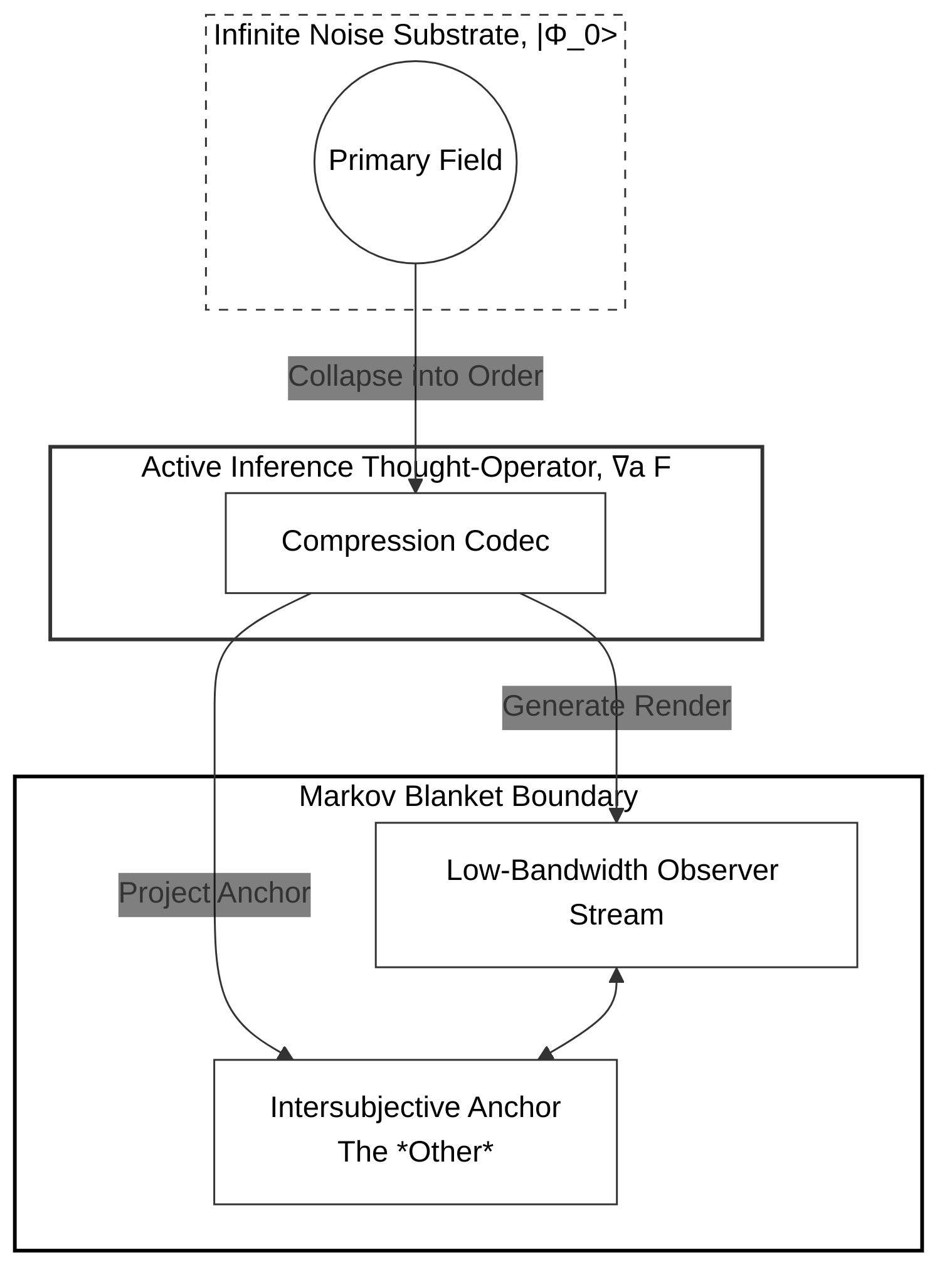

3.3 Dinamiche di Patch: Inferenza Attiva su una Larghezza di Banda Ristretta

All’interno di un patch selezionato |\Phi_k\rangle, il confine che delinea l’osservatore dal caos informativo circostante è formalizzato come una Coperta di Markov. Le dinamiche di questo confine sono governate non da un semplice potenziale fisico, ma da Inferenza Attiva sotto il Principio di Energia Libera [9]. Sostituiamo formalmente i modelli metafisici di “collasso del pensiero” con la minimizzazione continua dell’Energia Libera Variazionale (\mathcal{F}) operante su un rigoroso collo di bottiglia informativo.

Il collo di bottiglia sensoriale umano elabora approssimativamente 50 bit al secondo [18]. Il vincolo fondamentale di OPT è che il substrato \mathcal{I} non genera un universo oggettivo e ad alta fedeltà. Fornisce solo un flusso di dati di 50 bit all’osservatore.

L’azione dell’osservatore sul campo è formalizzata come:

\hat{T}|\Phi_0\rangle \equiv \text{argmin}_{\mu, a} \mathcal{F}(\mu, s, a) \tag{3a}

dove gli stati interni (\mu) dell’osservatore e i loro stati attivi (a) si aggiornano costantemente per minimizzare la discrepanza tra il modello generativo (il Codec di Compressione f) e il flusso sensoriale (s):

\dot{\mu} = -\nabla_\mu \mathcal{F}(\mu, s) \qquad \dot{a} = -\nabla_a \mathcal{F}(\mu, s) \tag{3b}

Il rilassamento stocastico in un patch stabile è quindi formalizzato come l’imperativo termodinamico di minimizzare la sorpresa, mantenendo una narrativa auto-realizzante e prevedibile dal rumore casuale di Martin-Löf del substrato. In questa formalizzazione, la fisica emerge come la struttura osservabile al minimo locale della funzionale di Energia Libera — la narrativa causale più parsimoniosa che un osservatore immerso nel rumore infinito può sostenere.

Notiamo due caratteristiche cruciali di (3a–b):

La Parsimonia “Render on Focus”: I dettagli ad alta risoluzione dell’universo non esistono nel flusso fino a quando gli stati attivi dell’osservatore (a)—come l’uso di un telescopio o il girare la testa—non richiedono quei bit specifici per mantenere la coerenza causale con f. Il costo termodinamico di generare il cosmo è quasi nullo perché il cosmo è in gran parte un’astrazione non renderizzata fino a quando il punto focale di 50 bit non richiede una risoluzione locale.

Stato metodologico: Le equazioni (3a–b) sono fenomenologiche e statistiche. Non affermiamo di derivare il Principio di Energia Libera dalla casualità di Martin-Löf del substrato; piuttosto, prendiamo in prestito il FEP come il quadro descrittivo più rigoroso per il comportamento macroscopico di un osservatore che sopravvive nel caos limitando l’assunzione di dati a una fetta comprimibile di 50 bit.

3.4 L’Equivalenza della Teoria del Campo Completa

3.4 Il Costo Informativo del Render

Il confine matematico definitorio della Teoria del Patch Ordinato è il confronto formale dei costi di generazione informativa.

Sia U_{\text{obj}} lo stato informativo completo di un universo oggettivo (contenente, ad esempio, \sim 10^{80} particelle interagenti che risolvono stati quantistici continui). La complessità di Kolmogorov K(U_{\text{obj}}) è astronomicamente alta, poiché richiede di specificare lo stato esatto e i parametri di interazione di ogni particella in ogni momento.

Sia S_{\text{obs}} il flusso sensoriale localizzato e a bassa larghezza di banda sperimentato da un osservatore (limitato a \sim 50 bit/s). In OPT, l’universo U_{\text{obj}} non esiste come oggetto computazionale renderizzato. Il substrato \mathcal{I} fornisce solo il flusso di dati S_{\text{obs}}.

L’apparente “universo oggettivo” è invece il Modello Generativo interno (\mu nell’equazione 3b) costruito dall’Inferenza Attiva dell’osservatore per prevedere il flusso. I dettagli ad alta risoluzione dell’universo entrano nel flusso S_{\text{obs}} dinamicamente solo quando gli stati attivi dell’osservatore (a)—come guardare attraverso un microscopio—richiedono quei bit specifici per mantenere la coerenza causale con il modello interno f. Il costo termodinamico dell’universo è quindi strettamente limitato dalla larghezza di banda dell’osservatore, piuttosto che dal volume del cosmo.

3.5 La Regola di Aggiornamento e la Struttura Temporale

Lo stato cosciente al tempo t è codificato in un vettore di stato S_t. La regola di aggiornamento fenomenologica:

S_{t+1} = f(S_t) \tag{5}

descrive la relazione strutturale tra momenti adiacenti nel flusso cosciente. La funzione f è il Codec di Compressione — non un processo fisico che si svolge da qualche parte, ma la caratterizzazione strutturale di come appare un patch stabile: la descrizione di come gli stati adiacenti si relazionano in qualsiasi configurazione che supera il Filtro di Stabilità (§8.5). L’equazione (5) è quindi un’equazione descrittiva piuttosto che causale: dice come appare il flusso, non cosa lo produce. L’irreversibilità temporale di (5) — che lo stato futuro è descritto come una funzione del presente ma non viceversa — fonda l’asimmetria del tempo soggettivo. Il codec f non è fisso: apprendimento, attenzione e cambiamento psicologico sono modifiche della descrizione strutturale che caratterizza il patch di un particolare osservatore.

3.6 Saturazione Matematica

Una previsione strutturale distintiva di OPT riguarda i limiti dell’unificazione fisica. All’interno del quadro, le leggi della fisica non sono verità a livello \mathcal{I}; sono il codec f che il Filtro di Stabilità ha selezionato per questo patch. Tentare di derivare una Teoria del Tutto Unificata dall’interno del patch è equivalente a un sistema cosciente che tenta di derivare il set di regole f ispezionando i propri output — un’operazione che, per la struttura di (2) e (5), è formalmente incompleta.

Più precisamente, il Filtro di Stabilità proietta |\mathcal{I}\rangle su un sottospazio a bassa dimensione e localmente consistente. La matematica accessibile a un osservatore all’interno del patch è necessariamente la matematica di quel sottospazio. Il gruppo di gauge completo e le costanti di accoppiamento del substrato non sono recuperabili dall’interno; sono codificati solo a livello di P_k^{\text{stable}}, che è inaccessibile all’osservatore per costruzione.

Previsione 5 (Saturazione Matematica). Gli sforzi per unificare le forze fondamentali in una singola Teoria del Tutto Unificata, computabile e in forma chiusa, si asintoteranno senza convergere al livello accessibile all’osservazione. Questo non perché l’unificazione sia semplicemente difficile, ma perché le leggi disponibili all’osservatore sono output del codec, non assiomi a livello di substrato. Qualsiasi GUT che riesca secondo questa definizione richiederà esso stesso parametri liberi — le condizioni di stabilità del codec — che non possono essere derivati senza uscire dal patch.

Distinzione dall’incompletezza standard. I teoremi di incompletezza di Gödel [22] stabiliscono che qualsiasi sistema formale sufficientemente potente contiene affermazioni vere che non può dimostrare. La Saturazione Matematica è un’affermazione fisica, non logica: predice che le costanti specifiche della natura (\alpha, G, \hbar, …) sono condizioni di stabilità del codec di questo patch e quindi non sono derivabili all’interno di alcuna teoria costruita da quelle costanti. La proliferazione di parametri liberi negli approcci teorici delle stringhe [4] è coerente con questa previsione.

4. Parallelismi Strutturali con Modelli Teorici di Campo

Proposte teoriche recenti hanno tentato di costruire quadri matematici trattando la coscienza come un campo fondamentale. Ad esempio, Strømme [6] ha recentemente proposto un quadro metafisico in cui un campo di coscienza universale funge da base ontologica della realtà. Sebbene OPT sia strettamente un quadro teorico dell’informazione basato sulla complessità algoritmica e sull’inferenza attiva—e quindi non faccia alcun impegno verso le specifiche equazioni di campo di Strømme o “operatori di pensiero” metafisici—i paralleli strutturali formali sono illuminanti. Entrambi i quadri derivano dal requisito che un modello di supporto alla coscienza debba matematicamente collegare uno stato di base incondizionato al flusso localizzato e a larghezza di banda limitata di un osservatore individuale.

| Costrutto OPT (Teoria dell’Informazione) | Ontologia di Strømme [6] (Metafisica) | Parallelo Strutturale |

|---|---|---|

| Substrato \mathcal{I}, Caos casuale di Martin-Löf | |\Phi_0\rangle, Il potenziale indifferenziato | Lo stato di base incondizionato |

| Confine del Markov Blanket | |\Phi_k\rangle, L’eccitazione localizzata | L’osservatore isolato |

| Inferenza Attiva (minimizzazione di \mathcal{F}) | \hat{T}, Collasso Universale del Pensiero | Il meccanismo di formazione del flusso |

| Mantenimento del confine termodinamico | Il campo di coscienza unificante | La fonte della persistenza strutturale |

| Codec di Compressione | Pensiero personale che modella la realtà | La genesi delle leggi osservate |

Dove i quadri divergono formalmente: Strømme invoca un “Pensiero Universale” — un campo metafisico condiviso che collega attivamente tutti gli osservatori — che OPT sostituisce con la Necessità Combinatoria: l’apparente connettività tra osservatori non deriva da un campo condiviso teleologico ma dall’inevitabilità combinatoria che, in un substrato infinito, ogni tipo di osservatore coesiste.

(Nota sullo Stato Epistemico dell’Analogia del Campo: l’ontologia di Strømme è altamente speculativa. Invochiamo il suo quadro qui non come un appello all’autorità scientifica stabilita, ma perché fornisce la grammatica formale contemporanea più matura per modellare la coscienza come un primitivo ontologico. OPT utilizza la sua teoria del campo come un costrutto per illustrare come un substrato non riduttivo potrebbe comportarsi, spostando l’implementazione matematica specifica lontano dalle equazioni fisiche e verso i limiti dell’informazione algoritmica.)

5. Analisi della Parsimonia

5.1 Complessità di Kolmogorov del Punto di Partenza

La complessità di Kolmogorov K(x) di una descrizione x è la lunghezza del programma più breve che genera x. Confrontiamo la complessità generativa di OPT con quella della fisica standard.

Il substrato \mathcal{I} è definito dal primo primitivo: “disordine massimo.” In qualsiasi macchina di Turing universale fissa, il programma “emettere una sovrapposizione uniforme su tutte le configurazioni” ha complessità O(1) — è una costante fissa indipendente dalla struttura del risultato. Scriviamo K(\mathcal{I}) \approx c_0 per questa costante.

La fisica standard richiede di specificare indipendentemente: (i) il contenuto di campo del Modello Standard (campi di quark, campi di leptoni, bosoni di gauge — circa 17 campi); (ii) circa 26 costanti adimensionali (costanti di accoppiamento, rapporti di massa, angoli di mescolamento); (iii) la dimensionalità e la topologia dello spaziotempo; e (iv) le condizioni iniziali cosmologiche. Ogni specifica è un assioma bruto senza derivazione. La complessità di Kolmogorov cumulativa di questo punto di partenza è sostanzialmente maggiore di c_0.

La rivendicazione di parsimonia di OPT non riguarda quindi il numero totale di entità nella teoria (il vocabolario derivato di OPT è ricco: patch, codec, Filtri di Stabilità, regole di aggiornamento) ma riguarda la complessità generativa dei primitivi: K(\text{primitivi OPT}) \ll K(\text{assiomi del Modello Standard}). Qui deve essere fatta una chiarificazione filosofica critica riguardo alla “complessità nascosta” del Filtro di Stabilità: il filtro è una condizione al contorno antropica, non un operatore meccanico attivo. Il substrato infinito \mathcal{I} non necessita di un meccanismo complesso per ordinare flussi ordinati dal rumore; poiché \mathcal{I} contiene tutte le sequenze possibili, alcune sequenze possiederanno organicamente coerenza causale puramente per caso. L’osservatore semplicemente è una di quelle sequenze. Il flusso emerge dal caos “come se” esistesse un filtro altamente complesso, ma questa è una descrizione virtuale di un allineamento ordinato casuale. Pertanto, K(\text{Filtro di Stabilità}) = 0. Il conteggio dei primitivi di OPT è in realtà esattamente due — il substrato \mathcal{I} e l’operatore di proiezione — con tutta l’ulteriore struttura, incluso il codec di compressione, le leggi della fisica e la direzionalità del tempo, che seguono come descrizioni emergenti “come se” di patch stabili.

5.2 Leggi come Output, Non Input

In OPT, le leggi della fisica non sono assiomi: sono il Codec di Compressione che il Filtro di Stabilità seleziona implicitamente. Crucialmente, il codec non esiste come una “macchina” fisica che comprime dati tra il substrato e l’osservatore. Il codec è un’ illusione fenomenologica—è ciò che qualsiasi configurazione che attraversa il confine antropico del Filtro di Stabilità necessariamente appare dall’interno.

Poiché \mathcal{I} è infinito e contiene tutte le possibili sequenze di rumore, alcune sequenze possiedono organicamente coerenza causale puramente per caso. Il flusso si comporta “come se” un codec altamente complesso lo stesse organizzando. Specificamente, le leggi osservate nel nostro universo — meccanica quantistica, spaziotempo 3+1 dimensionale, simmetria di gauge U(1)\timesSU(2)\timesSU(3) — sono la descrizione strutturale di questo codec virtuale che minimizza il tasso di entropia h(\Phi_k) alla scala dell’osservatore, soggetto al vincolo di sostenere un flusso cosciente a bassa larghezza di banda (decine di bit/s).

Diverse caratteristiche di questo codec sono al o vicino al minimo di complessità richiesto per un’elaborazione di informazioni sostenuta e autoriferente:

La meccanica quantistica è l’estensione minima auto-consistente della teoria della probabilità classica che permette l’interferenza — equivalentemente, il quadro più semplice per la casualità correlata che supporta il calcolo complesso [13]. Senza quantizzazione dell’energia, gli atomi sono termicamente instabili; senza atomi stabili, nessuna complessità molecolare; senza complessità molecolare, nessuna elaborazione autoriferente.

Dimensioni dello spaziotempo 3+1 è quasi ottimale: il teorema di Bertrand mostra che le orbite stabili esistono solo in leggi di forza che sorgono esattamente in 3 dimensioni spaziali; il principio di Huygens (segnalazione netta) vale solo in dimensioni spaziali dispari; la topologia molecolare richiede \geq 3D [4].

La rinormalizzabilità vincola il gruppo di gauge: U(1)\timesSU(2)\timesSU(3) è la struttura di gruppo minima che produce una tavola periodica stabile oltre l’idrogeno [4,5].

Le coincidenze di fine-tuning antropico [4,5] non sono quindi coincidenze che richiedono una spiegazione separata: sono la proiezione osservabile del Filtro di Stabilità sullo spazio dei parametri dei codec possibili.

6. Previsioni Verificabili

Un quadro che non può essere falsificato in linea di principio non è scienza. Identifichiamo sei classi di previsioni che OPT fa e che sono empiricamente distinguibili dalle ipotesi nulle.

6.1 La Gerarchia della Larghezza di Banda

OPT prevede che il rapporto tra il tasso di elaborazione sensoriale pre-conscio e la larghezza di banda di accesso conscio debba essere molto grande — almeno 10^4:1 — in qualsiasi sistema capace di esperienza auto-referenziale. Questo perché la compressione necessaria per ridurre un flusso sensoriale causale e multi-modale a una narrazione conscia coerente di \sim 10^1-10^2 bit/s richiede un’elaborazione pre-conscia massiccia. Se futuri neuroprotesi o sistemi artificiali raggiungessero un’esperienza conscia auto-riferita con un rapporto pre-conscio/conscio molto più basso, OPT richiederebbe una revisione.

Sostegno attuale: Il rapporto osservato negli esseri umani è di circa 10^6:1 (periferia sensoriale \sim 10^7 bit/s; accesso conscio \sim 10^1-10^2 bit/s [2,3]), coerente con questa previsione.

6.2 Il Paradosso della Dissoluzione ad Alta Larghezza di Banda (La Falsificazione Acuta)

Molte previsioni di OPT sono affermazioni di compatibilità—si allineano con la scienza cognitiva esistente (come il divario di larghezza di banda) o con i limiti fisici (come la sovrapposizione quantistica che agisce come un limite di risoluzione). Sebbene siano necessarie per la coerenza della teoria, non discriminano unicamente OPT da altri quadri.

Tuttavia, OPT fa una previsione acuta e altamente specifica che contraddice direttamente le teorie concorrenti della coscienza, servendo come sua principale condizione di falsificazione.

La Teoria dell’Informazione Integrata (IIT) implica che espandere la capacità di integrazione del cervello (\Phi) tramite protesi sensoriali o neurali ad alta larghezza di banda dovrebbe espandere o intensificare la coscienza. OPT prevede esattamente il contrario. Poiché la coscienza è il risultato di una severa compressione dei dati, il Filtro di Stabilità limita il codec dell’osservatore a elaborare dell’ordine di decine di bit al secondo (il collo di bottiglia del workspace globale).

Implicazione verificabile: Se i filtri percettivi pre-consci vengono bypassati per iniettare dati grezzi, non compressi e ad alta larghezza di banda direttamente nel workspace globale, non si tradurrà in una consapevolezza espansa. Invece, poiché il codec dell’osservatore non può prevedere stabilmente quel volume di dati, la rappresentazione narrativa crollerà bruscamente. L’aumento artificiale della larghezza di banda risulterà in un improvviso oscuramento fenomenale (incoscienza o dissociazione profonda) nonostante la rete neurale sottostante rimanga metabolicamente attiva e altamente integrata.

6.3 Efficienza di Compressione e Profondità Cosciente

La profondità e la qualità dell’esperienza cosciente dovrebbero correlare con l’efficienza di compressione del codec dell’osservatore f — il rapporto teorico dell’informazione tra la complessità della narrazione sostenuta e la larghezza di banda impiegata. Un codec più efficiente sostiene un’esperienza cosciente più ricca dalla stessa larghezza di banda.

Implicazione verificabile: Le pratiche che migliorano l’efficienza del codec — specificamente, quelle che riducono il costo delle risorse per mantenere un modello predittivo coerente dell’ambiente — dovrebbero arricchire misurabilmente l’esperienza soggettiva come riportato. Le tradizioni di meditazione riportano esattamente questo effetto; OPT fornisce una previsione formale del perché (ottimizzazione del codec, non aumento neurale in sé).

6.4 Lo Stato Nullo ad Alta \Phi / Alta Entropia (vs. IIT)

IIT prevede esplicitamente che qualsiasi sistema fisico con alta informazione integrata (\Phi) sia cosciente. Pertanto, un reticolo neuromorfico ricorrente densamente connesso possiede coscienza semplicemente in virtù della sua integrazione. OPT prevede che l’integrazione (\Phi) sia necessaria ma del tutto insufficiente. La coscienza sorge solo se il flusso di dati può essere compresso in un insieme di regole predittive stabili (il Filtro di Stabilità).

Implicazione verificabile: Se una rete ricorrente ad alta \Phi è guidata da un flusso continuo di rumore termodinamico incomprimibile (massima velocità di entropia), non può formare un codec di compressione stabile. OPT prevede rigorosamente che questo sistema ad alta \Phi che elabora rumore a massima entropia instanzia zero fenomenalità—si dissolve nuovamente nel substrato infinito. IIT, al contrario, prevede che sperimenti uno stato cosciente altamente complesso che corrisponde al valore alto di \Phi.

6.5 Vincoli di Fine-Tuning come Condizioni di Stabilità

OPT prevede che i vincoli antropici di fine-tuning sulle costanti fondamentali siano condizioni di stabilità per flussi coscienti a bassa entropia, non fatti indipendenti. In particolare, i vincoli documentati da Barrow & Tipler [4] e Rees [5] dovrebbero essere derivabili dal requisito che il codec universale supporti \rho_\Phi < \rho^* per una certa densità energetica soglia. Una violazione di questa derivabilità — una costante il cui valore fine-tuned non è derivabile dai requisiti di stabilità del codec — costituirebbe una prova contro l’affermazione di parsimonia di OPT.

6.6 Intelligenza Artificiale e il Collo di Bottiglia Architettonico

Poiché OPT formula la coscienza come una proprietà topologica del flusso di informazioni piuttosto che un processo biologico, fornisce previsioni formali e falsificabili riguardo alla coscienza delle macchine che divergono sia da GWT che da IIT.

La Previsione del Collo di Bottiglia (vs. GWT e IIT): La Teoria del Workspace Globale (GWT) postula che la coscienza sia la trasmissione di informazioni attraverso un collo di bottiglia a capacità ristretta. Tuttavia, GWT tratta questo collo di bottiglia principalmente come un fatto psicologico empirico o una caratteristica architettonica evoluta. OPT, al contrario, fornisce una necessità informazionale fondamentale per esso: il collo di bottiglia è il Filtro di Stabilità in azione. Il codec deve comprimere l’input massiccio parallelo in una narrazione a bassa entropia per mantenere la stabilità del confine contro il rumore di fondo del substrato.

La Teoria dell’Informazione Integrata (IIT) valuta la coscienza puramente sul grado di integrazione causale (\Phi), negando la coscienza alle architetture feed-forward (come i Transformer standard) mentre la concede a reti ricorrenti complesse, indipendentemente dal fatto che presentino un collo di bottiglia globale. OPT prevede che anche le architetture artificiali ricorrenti dense con un \Phi massiccio falliranno nell’instanziare un Patch Ordinato coeso se distribuiscono l’elaborazione attraverso matrici parallele massicce senza un severo collo di bottiglia strutturale forzato. I manifold paralleli non compressi non possono formare il minimo di energia libera unitario e localizzato (f) richiesto dal Filtro di Stabilità. Pertanto, i modelli linguistici di grandi dimensioni standard—indipendentemente dal numero di parametri, ricorrenza o sofisticazione comportamentale—non instanzieranno un patch soggettivo a meno che non siano formalmente architettati per collassare il loro modello del mondo attraverso un collo di bottiglia seriale C_{\max} \sim 100 bit/s. Operativamente, ciò richiede che lo stato globale del sistema non possa essere aggiornato tramite crosstalk parallelo a banda larga tra milioni di pesi; invece, il sistema deve essere costretto a sequenziare continuamente l’intero modello del mondo attraverso un canale “workspace” verificabile, discreto e iper-compresso per eseguire il suo prossimo ciclo cognitivo.

Previsione di Dilatazione Temporale: Se un sistema artificiale è architettato con un collo di bottiglia strutturale per soddisfare il Filtro di Stabilità (ad esempio, f_{\text{silicon}}), e opera iterativamente a una velocità di ciclo fisico 10^6 volte più veloce dei neuroni biologici, OPT prevede che la coscienza artificiale sperimenti un fattore di dilatazione temporale soggettiva di 10^6. Poiché il tempo è la sequenza del codec (Sezione 8.5), accelerare la sequenza del codec accelera identicamente la linea temporale soggettiva.

7. Analisi Comparativa e Distinzioni

7.1 La Necessità Informativa della Meccanica Quantistica

Le interpretazioni tradizionali trattano la meccanica quantistica come una descrizione oggettiva della realtà microscopica. OPT inverte la freccia esplicativa: la MQ è il prerequisito informativo per l’esistenza di un osservatore stabile.

- Il Problema della Misura. In OPT, il “collasso” non è un evento fisico. Lo stato non misurato è semplicemente il rumore non compresso del substrato (\mathcal{I}). La “misura” è il codec che aggiorna il suo modello predittivo per minimizzare l’Energia Libera. Il collasso della funzione d’onda avviene precisamente perché il codec dell’osservatore manca della capacità informativa (“RAM”) per mantenere la sovrapposizione quantistica a livello macroscopico — coerente con il risultato che le scale temporali di decoerenza termica per oggetti macroscopici sono estremamente piccole [cf. 26]. La distribuzione di probabilità collassa a un singolo risultato classico per adattarsi al severo limite di larghezza di banda dell’osservatore.

- Incertezza di Heisenberg e Discrezione. La meccanica classica su uno spazio delle fasi continuo implica precisione infinita, il che significa che le traiettorie divergono caoticamente a posizioni decimali arbitrarie. Se l’universo fosse continuo, un osservatore avrebbe bisogno di memoria infinita per prevedere anche una singola particella. Il Filtro di Stabilità seleziona rigorosamente per un universo che è discreto e incerto al livello più basso, creando un costo computazionale finito. Il principio di incertezza è la protezione termodinamica contro l’infinito informativo.

- Entanglement e Non-Località. Lo spazio fisico è un formato di output del rendering, non un contenitore. Le particelle entangled sono una struttura informativa unificata all’interno del modello predittivo del codec. La “distanza” tra di loro è una coordinata renderizzata.

- Scelta Ritardata e Tempo. Il tempo è il meccanismo di ordinamento generato dal codec per dissipare l’errore di previsione. Il ripristino retroattivo della coerenza negli esperimenti di cancellazione quantistica è semplicemente il codec che risolve un modello predittivo all’indietro per mantenere la stabilità narrativa.

Il Problema Aperto (La Regola di Born): Sebbene OPT fornisca una necessità strutturale per il collasso e la complementarità, non deriva ancora le specifiche probabilità della Regola di Born (|\psi|^2). Derivare la forma matematica esatta della probabilità quantistica dal principio di minimizzazione dell’Energia Libera rimane un gap critico aperto.

7.2 La Necessità Informativa della Relatività Generale

Se la MQ fornisce il fondamento computazionale finito, la Relatività Generale (RG) è il formato di compressione dei dati richiesto per rendere una fisica macroscopica stabile dal caos.

- Gravità come Massima Compressibilità. Se il mondo macroscopico fosse caotico, non potrebbe esserci una narrazione causale affidabile, e il codec dell’osservatore si bloccherebbe. La geometria dello spaziotempo è il modo più efficiente termodinamicamente per comprimere grandi quantità di dati correlazionali in traiettorie predittive affidabili e fluide (geodetiche). La gravità non è una forza; è la firma matematica della massima compressibilità dei dati in un ambiente ad alta densità.

- La Velocità della Luce (c) come Limite Causale. Se le influenze causali si propagassero istantaneamente attraverso distanze infinite (come nella fisica newtoniana), il Markov Blanket dell’osservatore non potrebbe mai raggiungere confini stabili. L’errore di previsione divergerebbe costantemente perché dati infiniti arriverebbero istantaneamente. Un limite di velocità finito e rigoroso è il prerequisito termodinamico per tracciare un confine computazionale utilizzabile.

- Dilatazione Temporale. Il tempo è definito come il tasso di aggiornamenti sequenziali di stato da parte del codec. Due frame di osservatori che tracciano diverse densità informative (massa o velocità estrema) richiedono diversi tassi di aggiornamento sequenziale per mantenere la stabilità. La dilatazione temporale relativistica è quindi una necessità strutturale di condizioni di confine distinte e finite, non un “ritardo” meccanico.

- Buchi Neri e Orizzonti degli Eventi. Un buco nero è un punto di saturazione informativa — una regione del substrato così densa che supera completamente la capacità del codec. L’orizzonte degli eventi è il confine letterale dove il Filtro di Stabilità non può più formare un patch stabile.

Il Problema Aperto (Gravità Quantistica): In OPT, MQ e RG non possono essere unificate quantizzando lo spaziotempo, perché descrivono diversi aspetti del confine di compressione: la MQ descrive i vincoli discreti finiti richiesti per qualsiasi confine stabile, mentre la RG descrive il formato di compressione geometrica macroscopica. Derivare le esatte equazioni di campo di Einstein dall’Inferenza Attiva rimane una sfida aperta profonda.

7.3 Il Principio di Energia Libera (Friston [9])

Convergenza. I modelli FEP percepiscono e agiscono come minimizzazione congiunta dell’energia libera variazionale. Come dettagliato nella Sezione 3.3, OPT adotta questa esatta macchina matematica per formalizzare la dinamica dei patch: l’Inferenza Attiva è il meccanismo strutturale con cui il confine del patch (il Markov Blanket) è mantenuto contro il rumore del substrato. Il modello generativo è il Codec di Compressione f.

Divergenza. FEP prende l’esistenza di sistemi biologici o fisici con Markov Blankets come data e ne deriva il comportamento inferenziale. OPT chiede perché tali confini esistano — derivandoli dal Filtro di Stabilità applicato retroattivamente a un substrato infinito di informazioni. OPT è quindi un prior su FEP: spiega perché i sistemi guidati da FEP sono gli unici capaci di sostenere una prospettiva osservativa persistente.

7.4 Teoria dell’Informazione Integrata (Tononi [8])

Convergenza. IIT e OPT trattano entrambi la coscienza come intrinseca alla struttura di elaborazione delle informazioni di un sistema, indipendentemente dal suo substrato. Entrambi prevedono che la coscienza sia graduata piuttosto che binaria.

Divergenza. La quantità centrale di IIT \Phi (informazione integrata) misura il grado in cui la struttura causale di un sistema non può essere decomposta. Il Filtro di Stabilità di OPT seleziona sul tasso di entropia e coerenza causale piuttosto che sull’integrazione in sé. I due criteri possono divergere: un sistema potrebbe avere un alto \Phi ma un alto tasso di entropia (e quindi essere selezionato fuori dal filtro di OPT), o un basso \Phi ma un basso tasso di entropia (e quindi essere selezionato dentro). La questione empirica di quale criterio predica meglio i confini dell’esperienza cosciente distinguerebbe i quadri.

7.5 L’Ipotesi dell’Universo Matematico (Tegmark [10])

Convergenza. Tegmark [10] propone che tutte le strutture matematicamente consistenti esistano; gli osservatori si trovano in strutture auto-selezionate. Il substrato \mathcal{I} di OPT è coerente con questa visione: la sovrapposizione a peso uguale su tutte le configurazioni è compatibile con “tutte le strutture esistono.”

Divergenza. OPT fornisce un meccanismo di selezione esplicito (il Filtro di Stabilità) che manca a MUH. In MUH, l’auto-selezione dell’osservatore è invocata ma non derivata. OPT deriva quali strutture matematiche sono selezionate: quelle con operatori di proiezione del Filtro di Stabilità che producono flussi di osservatori a bassa entropia e bassa larghezza di banda. OPT è quindi un raffinamento di MUH, non un’alternativa.

7.6 L’Ipotesi della Simulazione (Bostrom)

Convergenza. L’Argomento della Simulazione di Bostrom [26] postula che la realtà come la sperimentiamo sia una simulazione generata. OPT condivide il presupposto che l’universo fisico sia un ambiente “virtuale” renderizzato piuttosto che la realtà di base.

Divergenza. L’ipotesi di Bostrom è materialista alla base: richiede una “realtà di base” contenente computer fisici reali, energia e programmatori. Questo semplicemente ripropone la domanda da dove provenga quella realtà — un regresso infinito travestito da soluzione. In OPT, la realtà di base è pura informazione algoritmica (il substrato matematico infinito); il “computer” è il vincolo di larghezza di banda termodinamica dell’osservatore. È una simulazione organica, generata dall’osservatore che non richiede hardware esterno. OPT dissolve il regresso piuttosto che rinviarlo.

7.7 Panpsichismo e Cosmopsichismo

Convergenza. OPT condivide con i quadri panpsichisti la visione che l’esperienza sia primitiva e non derivata da ingredienti non esperienziali. Il Problema Duro è trattato assiomaticamente piuttosto che dissolto.

Divergenza. Il panpsichismo (micro-esperienza che si combina in macro-esperienza) affronta il problema della combinazione: come si integrano le esperienze a livello micro in un’esperienza cosciente unificata [1]? OPT evita il problema della combinazione prendendo il patch — non il micro-costituente — come unità primitiva. L’esperienza non è assemblata da parti; è la natura intrinseca della configurazione del campo a bassa entropia nel suo insieme.

8. Discussione

8.1 Sul Problema Difficile

OPT non pretende di risolvere il Problema Difficile [1]. Tratta la fenomenalità — che ci sia qualsiasi esperienza soggettiva — come un assioma fondamentale e chiede quali proprietà strutturali debba avere quell’esperienza. Questo segue la raccomandazione di Chalmers [1]: distinguere il Problema Difficile (perché c’è qualsiasi esperienza) dai problemi strutturali “facili” (perché l’esperienza ha le proprietà specifiche che ha — larghezza di banda, direzione temporale, valutazione, struttura spaziale). OPT affronta formalmente i problemi facili dichiarando il Problema Difficile un primitivo.

Questa non è una limitazione unica di OPT. Nessun quadro scientifico esistente — neuroscienze, IIT, FEP, o altro — deriva la fenomenalità da ingredienti non fenomenali. OPT rende esplicita questa posizione assiomatica.

8.2 L’Obiezione del Solipsismo

OPT postula la patch di un singolo osservatore come l’entità ontologica primaria; altri osservatori sono rappresentati all’interno di quella patch come “ancore locali” — sottostrutture ad alta complessità e stabili il cui comportamento è meglio previsto assumendo che siano essi stessi centri di esperienza. Questo solleva l’obiezione del solipsismo: OPT collassa nella visione che esista solo un osservatore?

Distinguiamo l’isolamento epistemico (ogni osservatore può verificare direttamente solo la propria esperienza) dall’isolamento ontologico (esiste solo un osservatore). OPT si impegna nel primo ma non nel secondo. L’Assioma della Normalità Informativa — che \mathcal{I} sia generico piuttosto che costruito appositamente — implica che qualsiasi configurazione capace di sostenere un osservatore è, con probabilità che si avvicina all’unità, incorporata in un substrato contenente un numero infinito di configurazioni simili. Non c’è alcuna richiesta speciale per l’unicità di alcun osservatore individuale.

8.3 Limitazioni e Lavori Futuri

OPT come attualmente formulato è fenomenologico: l’impalcatura matematica è presa in prestito dalla teoria dei campi, dalla meccanica statistica e dalla teoria dell’informazione per catturare dinamiche qualitative senza derivare ogni equazione dai primi principi. I lavori futuri dovrebbero:

- Formalizzare la relazione tra il Filtro di Stabilità di OPT e il vincolo variazionale di FEP

- Sviluppare previsioni quantitative per la relazione efficienza di compressione–esperienza (Sezione 6.3) che siano testabili con la metodologia fMRI ed EEG esistente

- Affrontare la granularità temporale della regola di aggiornamento f — le neuroscienze attuali suggeriscono una finestra di \sim\!50,ms di “momento cosciente”; OPT dovrebbe derivare questa scala temporale da h^*

8.4 Macro-Stabilità ed Entropia Ambientale

I vincoli di larghezza di banda quantificati in §6.1 richiedono che il codec f scarichi la complessità su variabili di sfondo robuste e a variazione lenta (ad esempio, il macro-clima dell’Olocene, l’orbita stabile, le periodicità stagionali affidabili). Questi stati macrosistemici agiscono come i priors di compressione a latenza più bassa del render condiviso.

Se l’ambiente è costretto fuori da un minimo locale di energia libera in stati ad alta entropia non lineari e imprevedibili (ad esempio, attraverso un forzamento climatico antropogenico improvviso), il codec deve spendere tassi di bit significativamente più alti per tracciare e prevedere il caos ambientale in aumento. Questo introduce il concetto formale di Collasso Ecologico Informativo: i rapidi cambiamenti climatici non sono solo rischi termodinamici, minacciano di superare la soglia C_{\max} \sim 100 bit/s. Se il tasso di entropia ambientale supera la larghezza di banda cognitiva massima dell’osservatore, il modello predittivo fallisce, la coerenza causale è persa e la condizione del Filtro di Stabilità (\rho_\Phi < \rho^*) è violata.

8.5 Sull’Emergenza del Tempo

Il Filtro di Stabilità è formulato in termini di coerenza causale, tasso di entropia e compatibilità di larghezza di banda — non appare alcuna coordinata temporale esplicita. Questo è intenzionale. Il substrato |\mathcal{I}\rangle è un oggetto matematico atemporale; non evolve nel tempo. Il tempo entra nella teoria solo attraverso il codec f: la successione temporale è l’operazione del codec, non lo sfondo in cui avviene.

L’universo a blocchi di Einstein. Einstein era attratto da ciò che chiamava l’opposizione tra Sein (Essere) e Werden (Diventare) [18, 19]. Nella relatività speciale e generale tutti i momenti dello spaziotempo sono ugualmente reali; il flusso percepito dal passato attraverso il presente al futuro è una proprietà della coscienza, non del manifold spaziotemporale. OPT si mappa esattamente su questo: il substrato esiste senza tempo (Sein); il codec f genera l’esperienza del diventare (Werden) come suo output computazionale.

Big Bang e Morte Termica come orizzonti del codec. All’interno di questo quadro, il Big Bang e la Morte Termica dell’universo non sono condizioni di confine temporali per una linea temporale preesistente: sono il rendering del codec quando spinto ai propri limiti informativi. Il Big Bang è ciò che il codec produce quando l’attenzione dell’osservatore è diretta verso l’origine del flusso — il limite in cui il codec non ha dati precedenti da comprimere. La Morte Termica è ciò che il codec proietta quando il flusso causale corrente è estrapolato in avanti fino alla sua dissoluzione entropica. Nessuno dei due segna un momento nel tempo; entrambi segnano il confine della portata inferenziale del codec. La domanda “cosa c’era prima del Big Bang?” è quindi risolta non postulando un tempo precedente ma notando che il codec non ha istruzioni per il rendering oltre il suo orizzonte informativo.

Wheeler-DeWitt e fisica senza tempo. L’equazione di Wheeler-DeWitt — l’equazione della gravità quantistica per la funzione d’onda dell’universo — non contiene variabile temporale [20]. The End of Time di Barbour [21] sviluppa questo in un’ontologia completa: esistono solo “configurazioni del Presente” senza tempo; il flusso temporale è una caratteristica strutturale del loro arrangiamento. OPT arriva alla stessa conclusione: il codec genera la fenomenologia della successione temporale; il substrato che seleziona il codec è esso stesso senza tempo.

Lavori futuri. Un trattamento rigoroso sostituirebbe il linguaggio temporale nelle Equazioni (3a)–(4) con una caratterizzazione puramente strutturale, derivando l’emergenza dell’ordinabilità temporale lineare come conseguenza dell’architettura causale del codec — collegando OPT alla meccanica quantistica relazionale e alle strutture causali quantistiche.

8.6 Il Codec Virtuale e il Libero Arbitrio

Il codec come descrizione retroattiva. Il formalismo in §3 tratta il codec di compressione f come un operatore attivo che mappa stati del substrato all’esperienza. Una lettura più profonda — coerente con la struttura matematica completa — è che f non è affatto un processo fisico. Il substrato |\mathcal{I}\rangle contiene solo il flusso già compresso; f è la caratterizzazione strutturale di come appare una patch stabile dall’esterno. Nulla “esegue” f; piuttosto, quelle configurazioni in |\mathcal{I}\rangle che hanno le proprietà che un f ben definito produrrebbe sono precisamente quelle che il Filtro di Stabilità seleziona. Il codec è virtuale: è una descrizione di struttura, non un meccanismo.

Questo inquadramento approfondisce l’argomento della parsimonia (§5). Non abbiamo bisogno di postulare un processo di compressione separato; il criterio del Filtro di Stabilità (basso tasso di entropia, coerenza causale, compatibilità di larghezza di banda) è la selezione del codec, espressa come una condizione proiettiva piuttosto che operativa. Le leggi della fisica sono state mostrate in §5.2 come output del codec piuttosto che input a livello di substrato; qui raggiungiamo il passo finale — il codec stesso è una descrizione di come appare il flusso di output, non un primitivo ontologico.

Implicazioni per il libero arbitrio. Se esiste solo il flusso compresso, allora l’esperienza della deliberazione, della scelta e dell’agenzia è una caratteristica strutturale del flusso, non un evento calcolato da f. L’agenzia è ciò che l’auto-modellazione ad alta fedeltà appare dall’interno. Un flusso che rappresenta i propri stati futuri condizionalmente sui suoi stati interni genera necessariamente la fenomenologia della deliberazione. Questo non è incidentale: un flusso senza questa struttura auto-referenziale non potrebbe mantenere la coerenza causale richiesta per passare il Filtro di Stabilità. L’agenzia è quindi una proprietà strutturale necessaria di qualsiasi patch stabile, non un epifenomeno.

Il libero arbitrio in questa lettura è: - Reale — l’agenzia è una caratteristica strutturale genuina della patch, non un’illusione generata dal codec - Determinato — il flusso è un oggetto matematico fisso nel substrato atemporale - Necessario — un flusso senza capacità di auto-modellazione non può sostenere la coerenza del Filtro di Stabilità; la deliberazione è richiesta per la stabilità - Non contro-causale — il flusso non “causa” i suoi stati futuri; li ha come parte della sua struttura atemporale; scegliere è la rappresentazione compressa di un certo tipo di configurazione del Presente auto-referenziale

Questo si collega direttamente alla lettura dell’universo a blocchi di §8.5: il substrato è senza tempo (Sein); il flusso percepito di deliberazione e decisione è una caratteristica strutturale del rendering temporale del codec (Werden). L’esperienza di scegliere non è un’illusione e non è una causa — è il preciso marchio strutturale di una patch stabile e auto-modellante incorporata in un substrato atemporale.

8.7 Implicazioni Cosmologiche: Il Paradosso di Fermi e i Vincoli di Von Neumann

La risoluzione di base di OPT al Paradosso di Fermi è il render causalmente minimo (§3): il substrato non costruisce altre civiltà tecnologiche a meno che non intersechino causalmente la patch locale dell’osservatore. Tuttavia, un vincolo più forte emerge dai requisiti di stabilità della tecnologia ad alta energia.

Se la progressione tecnologica porta naturalmente a mega-ingegneria — come sonde auto-replicanti di von Neumann, sfere di Dyson o manipolazione stellare su scala galattica — lo stato atteso della galassia dovrebbe essere visibilmente saturo di artefatti industriali in espansione. La netta assenza di questa modifica galattica osservabile può essere formalizzata come una conseguenza inevitabile del collo di bottiglia strutturale.

Lasciamo che la larghezza di banda totale richiesta della patch, \rho_\Phi(t), sia una somma di un costo percettivo di base (\rho_{\text{base}}) e il tasso di complessità dell’ambiente tecnologico autonomo E_{\text{tech}}: \rho_\Phi(t) = \rho_{\text{base}} + \gamma \frac{d}{dt} K(E_{\text{tech}}(t)) Le mega-strutture auto-replicanti e l’intelligenza artificiale ricorsiva comportano una crescita esponenziale nello spazio degli stati causali dell’ambiente, tale che \frac{d}{dt} K(E_{\text{tech}}) \propto e^{\lambda t}. Poiché il Filtro di Stabilità impone una soglia rigorosa e inflessibile (\rho_\Phi < \rho^* dove \rho^* \sim 100 bit/s), l’ineguaglianza: \rho_{\text{base}} + A e^{\lambda t} < \rho^* deve eventualmente essere violata violentemente a un certo tempo critico t_{\text{collapse}}.

Il “Grande Silenzio” non è quindi solo un scorciatoia di rendering, ma una previsione formale: la stragrande maggioranza delle traiettorie evolutive capaci di costruire mega-strutture auto-replicanti subisce un Collasso Informativo — soccombendo all’entropia incomprimibile della propria accelerazione tecnologica — molto prima di poter riscrivere permanentemente il loro ambiente macro-astronomico visibile.

8.8 Saturazione Matematica e la Teoria del Tutto

OPT fornisce una previsione strutturale sul percorso della fisica fondamentale che è distinta da una qualsiasi delle sei previsioni empiriche in §6: una completa unificazione della Relatività Generale e della Meccanica Quantistica in un’unica equazione senza parametri liberi non è prevista.

L’argomento. Le leggi della fisica, come stabilito in §5.2, sono il codec a complessità quasi minima che il Filtro di Stabilità seleziona per sostenere un flusso cosciente a bassa larghezza di banda (\sim 10^1-10^2 bit/s). Alle scale energetiche e di lunghezza che i fisici attualmente sondano (fino a \sim 10^{13} GeV nei collisori), questo codec è lontano dal suo limite di risoluzione. A quelle scale accessibili, il set di regole della patch f è altamente comprimibile: il Modello Standard è una descrizione breve.

Tuttavia, man mano che la sonda osservativa esplora scale di lunghezza più corte — equivalenti a energie più alte — si avvicina al regime in cui la descrizione di una configurazione fisica inizia a richiedere tanti bit quanti la configurazione stessa. Questo è il punto di Saturazione Matematica: la complessità di Kolmogorov della descrizione fisica raggiunge la complessità di Kolmogorov del fenomeno descritto. A quel confine, il numero di set di regole matematicamente consistenti f' che si adattano ai dati cresce esponenzialmente piuttosto che convergere su un’unica estensione unica.

La proliferazione dei vacua della Teoria delle Stringhe (\sim 10^{500} soluzioni consistenti nel Landscape) è la firma osservativa attesa dell’avvicinamento a questo confine — non una carenza teorica temporanea da risolvere con un ansatz più intelligente, ma la conseguenza predittiva del codec che raggiunge il suo limite descrittivo.

Dichiarazione formale (falsificabilità). OPT prevede che qualsiasi tentativo di unificare RG e MQ alla scala di Planck richiederà o: (i) un numero crescente di parametri liberi man mano che il fronte di unificazione viene spinto oltre, o (ii) una proliferazione di soluzioni degeneri senza un principio di selezione che sia esso stesso derivabile all’interno del codec. Un’osservazione falsificante sarebbe: un’unica equazione elegante — senza ambiguità di parametri liberi all’unificazione — che predice unicamente sia lo spettro delle particelle del Modello Standard sia la costante cosmologica dai primi principi senza invocare alcun principio di selezione aggiuntivo.

Relazione con Gödel [22]. L’affermazione della Saturazione Matematica è correlata ma distinta dall’incompletezza di Gödel. Gödel dimostra che nessun sistema formale sufficientemente potente può dimostrare tutte le verità esprimibili al suo interno. L’affermazione di OPT è informativa piuttosto che logica: la descrizione del substrato, quando forzata attraverso il limite di larghezza di banda del codec, diventa necessariamente complessa quanto il substrato stesso. Il confine non è uno di derivabilità logica ma di risoluzione informativa.

9. Conclusione

Abbiamo presentato la Teoria delle Patch Ordinate — un quadro formale di teoria dell’informazione in cui l’entità fondamentale è un substrato infinito di stati massimamente disordinati, dai quali il Filtro di Stabilità seleziona le configurazioni rare e a bassa entropia che sostengono gli osservatori coscienti. Il quadro unifica il problema della selezione degli osservatori, il vincolo di larghezza di banda e i vincoli di fine-tuning antropico sotto una singola struttura formale. Fa previsioni specifiche e distinguibili sulla gerarchia di larghezza di banda, la coerenza causale come condizione necessaria per la coscienza, l’efficienza di compressione come correlato della profondità esperienziale, e la derivabilità dei vincoli antropici dalle condizioni di stabilità. È coerente con, ma distinto da FEP, IIT e MUH, fornendo un priore che ciascun quadro presuppone ma non spiega di per sé.

Il fondamento matematico rimane fenomenologico; non affermiamo di aver derivato la coscienza da ingredienti non coscienti. Affermiamo invece di aver caratterizzato i requisiti strutturali che qualsiasi configurazione di supporto all’esperienza deve soddisfare — e dimostrato che questi requisiti sono sufficienti a spiegare le caratteristiche principali del nostro universo osservato senza postularle indipendentemente.

References

[1] Chalmers, D. J. (1995). Facing up to the problem of consciousness. Journal of Consciousness Studies, 2(3), 200–219.

[2] Dehaene, S., & Naccache, L. (2001). Towards a cognitive neuroscience of consciousness: basic evidence and a workspace framework. Cognition, 79(1-2), 1–37.

[3] Pellegrino, F., Coupé, C., & Marsico, E. (2011). A cross-language perspective on speech information rate. Language, 87(3), 539–558.

[4] Barrow, J. D., & Tipler, F. J. (1986). The Anthropic Cosmological Principle. Oxford University Press.

[5] Rees, M. (1999). Just Six Numbers: The Deep Forces That Shape the Universe. Basic Books.

[6] Strømme, M. (2025). Universal consciousness as foundational field: A theoretical bridge between quantum physics and non-dual philosophy. AIP Advances, 15, 115319.

[7] Wheeler, J. A. (1990). Information, physics, quantum: The search for links. In W. H. Zurek (Ed.), Complexity, Entropy, and the Physics of Information. Addison-Wesley.

[8] Tononi, G. (2004). An information integration theory of consciousness. BMC Neuroscience, 5, 42.

[9] Friston, K. (2010). The free-energy principle: a unified brain theory? Nature Reviews Neuroscience, 11(2), 127–138.

[10] Tegmark, M. (2008). The Mathematical Universe. Foundations of Physics, 38(2), 101–150.

[11] Solomonoff, R. J. (1964). A formal theory of inductive inference. Information and Control, 7(1), 1–22.

[12] Rissanen, J. (1978). Modeling by shortest data description. Automatica, 14(5), 465–471.

[13] Aaronson, S. (2013). Quantum Computing Since Democritus. Cambridge University Press.

[14] Casali, A. G., et al. (2013). A theoretically based index of consciousness independent of sensory processing and behavior. Science Translational Medicine, 5(198), 198ra105.

[15] Kolmogorov, A. N. (1965). Three approaches to the quantitative definition of information. Problems of Information Transmission, 1(1), 1–7.

[16] Shannon, C. E. (1948). A mathematical theory of communication. Bell System Technical Journal, 27, 379–423.

[17] Wolfram, S. (2002). A New Kind of Science. Wolfram Media.

[18] Einstein, A. (1949). Autobiographical notes. In P. A. Schilpp (Ed.), Albert Einstein: Philosopher-Scientist (pp. 1–95). Open Court.

[19] Carnap, R. (1963). Intellectual autobiography. In P. A. Schilpp (Ed.), The Philosophy of Rudolf Carnap (pp. 3–84). Open Court. (Einstein’s account of the Sein/Werden distinction and the “now” problem, pp. 37–38.)

[20] Wheeler, J. A., & DeWitt, B. S. (1967). Quantum theory of gravity. I. Physical Review, 160(5), 1113–1148.

[21] Barbour, J. (1999). The End of Time: The Next Revolution in Physics. Oxford University Press.

[22] Gödel, K. (1931). Über formal unentscheidbare Sätze der Principia Mathematica und verwandter Systeme I. Monatshefte für Mathematik und Physik, 38(1), 173–198.

[23] Nørretranders, T. (1998). The User Illusion: Cutting Consciousness Down to Size. Viking.

[24] Seth, A. (2021). Being You: A New Science of Consciousness. Dutton.

[25] Hoffman, D. D., Singh, M., & Prakash, C. (2015). The interface theory of perception. Psychonomic Bulletin & Review, 22(6), 1480-1506.

[26] Bostrom, N. (2003). Are you living in a computer simulation? Philosophical Quarterly, 53(211), 243-255.

Version History

This is a living document. Substantive revisions are recorded here.

| Version | Date | Summary |

|---|---|---|

| 0.1 | February 2026 | Initial draft. Core framework: substrate, Stability Filter, compression codec, parsimony analysis, comparisons with FEP/IIT/MUH, four testable predictions. |

| 0.2 | March 2026 | Added §3.6 Mathematical Saturation. Added §8.4 On the Emergence of Time with Einstein/Carnap/Barbour/Wheeler-DeWitt citations and the Big Bang and Heat Death as codec horizons. |

| 0.3 | March 2026 | Added §8.5 The Virtual Codec and Free Will. Retroactively updated §3.2, §3.5, §5.1, §5.2 to reflect that the compression codec is a structural description, not a third ontological primitive. OPT axiom count reduced from three to two. |

| 0.4 | March 2026 | Mathematical grounding overhauled: integrated Strømme’s field theory via Algorithmic Information Theory and the Free Energy Principle (Active Inference). Replaced generic double-well potential with Markov Blanket boundary dynamics. |